Wirtualny system kamer

|

| Część serii poświęconej |

| grafice gier wideo |

|---|

W grach wideo 3D system wirtualnej kamery ma na celu sterowanie kamerą lub zestawem kamer w celu wyświetlenia widoku wirtualnego świata 3D . Systemy kamer są wykorzystywane w grach wideo, gdzie ich celem jest pokazanie akcji pod jak najlepszym kątem; bardziej ogólnie, są one używane w wirtualnych światach 3D, gdy wymagany jest widok z perspektywy trzeciej osoby.

W przeciwieństwie do filmowców, twórcy systemów kamer wirtualnych muszą radzić sobie ze światem interaktywnym i nieprzewidywalnym. Nie można wiedzieć, gdzie postać gracza będzie się znajdować w ciągu najbliższych kilku sekund; dlatego nie jest możliwe zaplanowanie ujęć tak, jak zrobiłby to filmowiec. Aby rozwiązać ten problem, system opiera się na pewnych zasadach lub sztucznej inteligencji , aby wybrać najbardziej odpowiednie ujęcia.

Istnieją głównie trzy rodzaje systemów kamer. W stałych systemach kamer kamera w ogóle się nie porusza, a system wyświetla postać gracza w serii nieruchomych ujęć. Z kolei kamery śledzące śledzą ruchy postaci. Wreszcie, interaktywne systemy kamer są częściowo zautomatyzowane i pozwalają graczowi na bezpośrednią zmianę widoku. Aby wdrożyć systemy kamer, twórcy gier wideo wykorzystują takie techniki, jak narzędzia do rozwiązywania ograniczeń , skrypty sztucznej inteligencji lub autonomiczni agenci .

Widok z perspektywy trzeciej osoby

W grach wideo „trzecioosobowa” odnosi się do perspektywy graficznej renderowanej ze stałej odległości za i nieco powyżej postaci gracza. Ten punkt widzenia pozwala graczom zobaczyć silniej scharakteryzowany awatar i jest najczęściej spotykany w grach akcji i przygodowych grach akcji . Gry z tą perspektywą często wykorzystują dźwięk pozycyjny, w którym głośność dźwięków otoczenia zmienia się w zależności od pozycji awatara.

Istnieją przede wszystkim trzy typy systemów kamer z perspektywy trzeciej osoby: „systemy kamer stałych”, w których pozycje kamery są ustawiane podczas tworzenia gry; „systemy kamer śledzących”, w których kamera po prostu podąża za postacią gracza; oraz „interaktywne systemy kamer”, które są pod kontrolą gracza.

Naprawił

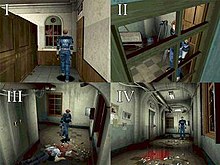

W przypadku stałego systemu kamer twórcy ustalają właściwości kamery, takie jak jej położenie, orientacja czy pole widzenia , podczas tworzenia gry. Widoki z kamer nie będą się zmieniać dynamicznie, więc to samo miejsce będzie zawsze pokazywane w tym samym zestawie widoków. Gry wykorzystujące stałe kamery to Grim Fandango (1998) oraz wczesne gry Resident Evil i God of War .

Jedną z zalet tego systemu kamer jest to, że pozwala projektantom gry używać języka filmu , tworząc nastrój poprzez pracę kamery i dobór ujęć. Gry korzystające z tego rodzaju techniki są często chwalone za swoje kinowe właściwości. Wiele gier ze stałymi kamerami wykorzystuje sterowanie czołgiem , w którym gracze kontrolują ruch postaci w stosunku do pozycji postaci gracza , a nie pozycji kamery; pozwala to graczowi zachować kierunek, gdy zmienia się kąt kamery.

Śledzenie

Kamery śledzące śledzą postacie od tyłu. Gracz nie kontroluje w żaden sposób kamery – nie może jej np. obrócić ani przesunąć w inne miejsce. Ten typ systemu kamer był bardzo powszechny we wczesnych grach 3D, takich jak Crash Bandicoot czy Tomb Raider ponieważ jest bardzo prosty w wykonaniu. Wiąże się z tym jednak kilka problemów. W szczególności, jeśli bieżący widok nie jest odpowiedni (ponieważ jest zasłonięty przez obiekt lub nie pokazuje tego, co interesuje gracza), nie można go zmienić, ponieważ gracz nie kontroluje kamery. Czasami ten punkt widzenia sprawia trudności, gdy postać odwraca się lub stoi twarzą do ściany. Aparat może szarpnąć lub znaleźć się w niewygodnej pozycji.

Interaktywny

Ten typ systemu kamer jest ulepszeniem w stosunku do systemu kamer śledzących. Podczas gdy kamera wciąż śledzi postać, niektóre jej parametry, takie jak orientacja czy odległość od postaci, można zmienić. Na konsolach do gier wideo kamera jest często sterowana za pomocą drążka analogowego , aby zapewnić dobrą dokładność, podczas gdy w grach na komputery PC jest zwykle kontrolowana za pomocą myszy . Tak jest w takich grach jak Super Mario Sunshine czy The Legend of Zelda: The Wind Waker . W pełni interaktywne systemy kamer są często trudne do wdrożenia we właściwy sposób. Zatem GameSpot twierdzi, że wiele trudności w Super Mario Sunshine wynika z konieczności kontrolowania kamery. The Legend of Zelda: The Wind Waker odniósł w tym większy sukces - IGN nazwał system kamer „tak inteligentnym, że rzadko wymaga ręcznej korekty”.

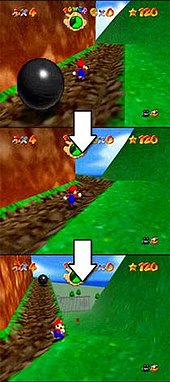

Jedną z pierwszych gier oferujących interaktywny system kamer był Super Mario 64 . Gra posiadała dwa rodzaje systemów kamer, pomiędzy którymi gracz mógł się przełączać w dowolnym momencie. Pierwszym z nich był standardowy system kamer śledzących, z tą różnicą, że był częściowo napędzany przez sztuczną inteligencję . Rzeczywiście, system był „świadomy” struktury poziomu i dlatego mógł przewidzieć niektóre strzały. Na przykład na pierwszym poziomie, gdy ścieżka na wzgórze ma skręcić w lewo, kamera automatycznie zaczyna patrzeć również w lewo, przewidując w ten sposób ruchy gracza. Drugi typ pozwala graczowi na sterowanie kamerą w stosunku do Stanowisko Mario . Naciskając lewy lub prawy przycisk, kamera obraca się wokół Mario, podczas gdy naciśnięcie w górę lub w dół przybliża lub oddala kamerę od Mario.

Realizacja

Istnieje wiele badań dotyczących sposobu wdrażania systemu kamer. Rolą oprogramowania do rozwiązywania ograniczeń jest wygenerowanie najlepszego możliwego ujęcia, biorąc pod uwagę zestaw ograniczeń wizualnych. Innymi słowy, osoba rozwiązująca ograniczenia otrzymuje żądaną kompozycję ujęcia, na przykład „pokaż tę postać i upewnij się, że zajmuje co najmniej 30 procent powierzchni ekranu”. Solver użyje następnie różnych metod, aby spróbować stworzyć ujęcie, które spełniłoby to żądanie. Po znalezieniu odpowiedniego ujęcia solver podaje współrzędne i obrót kamery, które mogą być następnie wykorzystane przez renderer silnika graficznego do wyświetlenia widoku.

W niektórych systemach kamer, jeśli nie można znaleźć rozwiązania, ograniczenia są rozluźniane. Na przykład, jeśli solver nie może wygenerować ujęcia, w którym postać zajmuje 30 procent miejsca na ekranie, może zignorować ograniczenie miejsca na ekranie i po prostu upewnić się, że postać jest w ogóle widoczna. Takie metody obejmują pomniejszanie.

Niektóre systemy kamer używają predefiniowanych skryptów, aby zdecydować, jak wybrać bieżące ujęcie dla często spotykanych scenariuszy ujęć zwanych idiomami filmowymi. Zazwyczaj skrypt zostanie uruchomiony w wyniku akcji. Na przykład, gdy postać gracza zainicjuje rozmowę z inną postacią, uruchomi się skrypt „konwersacji”. Ten skrypt będzie zawierał instrukcje, jak „nakręcić” dwuznakową rozmowę. Ujęcia będą więc kombinacją np. ujęć przez ramię i zbliżeń strzały. Takie podejście oparte na skryptach może przełączać kamerę między zestawem predefiniowanych kamer lub polegać na rozwiązaniu ograniczeń w celu wygenerowania współrzędnych kamery w celu uwzględnienia zmienności układu sceny. To oparte na skryptach podejście i użycie narzędzia do rozwiązywania ograniczeń do obliczania kamer wirtualnych zostało po raz pierwszy zaproponowane przez Druckera. Późniejsze badania wykazały, w jaki sposób system oparty na skryptach może automatycznie przełączać kamery, aby wyświetlać rozmowy między awatarami w aplikacji do czatowania w czasie rzeczywistym.

Bill Tomlinson zastosował bardziej oryginalne podejście do problemu. Wymyślił system, w którym kamera jest autonomicznym agentem z własną osobowością. Na styl ujęć i ich rytm będzie miał wpływ nastrój. W ten sposób szczęśliwy aparat „będzie częściej ciąć, spędzać więcej czasu na ujęciach z bliska, poruszać się sprężystym, opadającym ruchem i jasno oświetlać scenę”.

Podczas gdy większość wcześniejszych prac nad zautomatyzowanymi systemami sterowania kamerami wirtualnymi była ukierunkowana na ograniczenie konieczności ręcznego sterowania kamerą przez człowieka, rozwiązanie Director's Lens oblicza i proponuje paletę sugerowanych ujęć z kamery wirtualnej, pozostawiając operatorowi kreatywność wybór strzału. Przy obliczaniu kolejnych sugerowanych ujęć kamery wirtualnej system analizuje kompozycje wizualne i wzorce edycji wcześniej nagranych ujęć w celu obliczenia sugerowanych ujęć kamery, które są zgodne z konwencjami ciągłości, takimi jak nieprzekraczanie linii akcji, dopasowanie rozmieszczenia wirtualnych postaci w taki sposób, aby wyglądały do siebie w poprzek cięć i faworyzuje te strzały, które człowiek-operator użył wcześniej w sekwencji.

W aplikacjach rzeczywistości mieszanej

W 2010 roku Microsoft wypuścił Kinect jako hybrydowe urządzenie peryferyjne skanera 3D / kamery internetowej , które zapewnia wykrywanie całego ciała graczy Xbox 360 i sterowanie bez użycia rąk interfejsami użytkownika gier wideo i innego oprogramowania na konsoli. Zostało to później zmodyfikowane przez Olivera Kreylosa z University of California w Davis w serii filmów na YouTube, które pokazały mu połączenie Kinecta z wirtualną kamerą na PC. Ponieważ Kinect jest w stanie wykryć pełny zakres głębi (poprzez stereowizję komputerową i Światło strukturalne ) w przechwyconej scenie Kreylos zademonstrował możliwości Kinect i wirtualnej kamery, aby umożliwić nawigację w zakresie głębokości z dowolnego punktu widzenia, chociaż kamera mogła pozwolić tylko na przechwytywanie wideo sceny, jak pokazano z przodu Kinect, co skutkowało polami czarnej, pustej przestrzeni, w których kamera nie była w stanie uchwycić wideo w polu głębi. Później Kreylos zademonstrował dalsze rozwinięcie modyfikacji, łącząc strumienie wideo z dwóch Kinectów w celu dalszego ulepszenia przechwytywania wideo w widoku z wirtualnej kamery. Rozwój Kreylosa wykorzystujący Kinect został omówiony między pracami innych osób w hakowaniu Kinect i społeczności homebrew w artykule w New York Times .

Nagrywanie w czasie rzeczywistym i śledzenie ruchu

Opracowano wirtualne kamery, które umożliwiają reżyserowi filmowanie motion capture i oglądanie ruchów postaci cyfrowych w czasie rzeczywistym we wstępnie skonstruowanym środowisku cyfrowym, takim jak dom lub statek kosmiczny. Resident Evil 5 była pierwszą grą wideo wykorzystującą technologię, która została opracowana na potrzeby filmu Avatar z 2009 roku . Wykorzystanie przechwytywania ruchu do kontrolowania pozycji i orientacji kamery wirtualnej umożliwia operatorowi intuicyjne przesuwanie i celowanie kamerą wirtualną, po prostu chodząc i obracając wirtualną kamerę. Zestaw kamery wirtualnej składa się z przenośnego monitora lub tabletu, czujników ruchu, opcjonalnej ramy pomocniczej oraz opcjonalnego joysticka lub przycisków sterujących, które są powszechnie używane do rozpoczynania i zatrzymywania nagrywania oraz dostosowywania właściwości obiektywu. W 1992 roku Michael McKenna z Media Lab MIT zademonstrował najwcześniejszą udokumentowaną wirtualną kamerę, mocując magnetyczny czujnik ruchu Polhemus i 3,2-calowy przenośny telewizor LCD do drewnianej linijki. W ramach projektu Walkthrough na Uniwersytecie Północnej Karoliny w Chapel Hill wyprodukowano szereg fizycznych urządzeń wejściowych do sterowania widokiem z kamery wirtualnej, w tym dwa trójosiowe joysticki i rekwizyt w kształcie kuli bilardowej, znany jako UNC Eyeball, który zawierał wbudowany sześciostopniowy tracker ruchu Freedom i przycisk cyfrowy.

Zobacz też