Historia sprzętu komputerowego

| Historia |

|---|

| sprzętu komputerowego |

| Oprogramowanie |

| Informatyka |

| Nowoczesne koncepcje |

| Według kraju |

| Oś czasu obliczeń |

| Słowniczek informatyki |

Historia sprzętu komputerowego obejmuje rozwój od wczesnych prostych urządzeń wspomagających obliczenia do współczesnych komputerów .

Pierwszą pomocą w obliczeniach były urządzenia czysto mechaniczne, które wymagały od operatora ustawienia początkowych wartości elementarnej operacji arytmetycznej , a następnie manipulowania urządzeniem w celu uzyskania wyniku. Później komputery przedstawiały liczby w postaci ciągłej (np. odległość na skali, obrót wału, napięcie ) . Liczby mogą być również reprezentowane w postaci cyfr, automatycznie manipulowanych przez mechanizm. Chociaż takie podejście na ogół wymagało bardziej złożonych mechanizmów, znacznie zwiększyło precyzję wyników. Rozwój tranzystorowej , a następnie tzw Układ scalony doprowadził do szeregu przełomów, poczynając od komputerów tranzystorowych, a następnie komputerów z układami scalonymi, powodując, że komputery cyfrowe w dużej mierze zastąpiły komputery analogowe . Integracja na dużą skalę (LSI ) metal-tlenek-półprzewodnik (MOS ) umożliwiła następnie pamięć półprzewodnikową i mikroprocesor , prowadząc do kolejnego kluczowego przełomu, zminiaturyzowanego komputera osobistego (PC) w latach 70. Koszt komputerów stopniowo stał się tak niski, że do lat 90. komputery osobiste, a następnie komputery mobilne ( smartfony i tablety ) w 2000 roku stały się wszechobecne.

Wczesne urządzenia

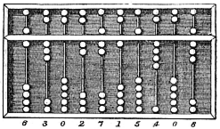

Starożytne i średniowieczne

Urządzenia były używane do wspomagania obliczeń od tysięcy lat, głównie za pomocą korespondencji jeden do jednego z palcami . Najwcześniejszym urządzeniem liczącym była prawdopodobnie forma licznika . Kość Lebombo z gór między Eswatini a Republiką Południowej Afryki może być najstarszym znanym artefaktem matematycznym. Pochodzi z 35 000 pne i składa się z 29 różnych nacięć, które celowo wycięto w kości strzałkowej pawiana . Późniejsze pomoce do prowadzenia dokumentacji w całym Żyznym Półksiężycu zawierały kamienie (kulki gliny, szyszki itp.), które przedstawiały liczbę przedmiotów, prawdopodobnie żywego inwentarza lub zboża, zamkniętych w wydrążonych niewypalonych glinianych pojemnikach. Jednym z przykładów jest użycie prętów liczących . Liczydło było wcześnie używane do zadań arytmetycznych . To, co obecnie nazywamy rzymskim liczydłem, było używane w Babilonii już ok. 2700-2300 pne. Od tego czasu wynaleziono wiele innych form tablic lub stołów do liczenia. W średniowiecznym europejskim kantorze , na stole kładziono obrus w kratkę i przesuwano po nim znaczniki według określonych zasad, jako pomoc w obliczaniu sum pieniężnych.

W starożytności i średniowieczu zbudowano kilka komputerów analogowych do wykonywania obliczeń astronomicznych. Obejmowały one astrolabium i mechanizm z Antykithiry ze świata hellenistycznego (ok. 150–100 pne). W rzymskim Egipcie Hero z Aleksandrii (ok. 10–70 ne) wykonał urządzenia mechaniczne, w tym automaty i programowalny wózek. Inne wczesne urządzenia mechaniczne używane do wykonywania tego lub innego rodzaju obliczeń obejmują planisferę i inne mechaniczne urządzenia obliczeniowe wynalezione przez Al-Biruni (ok. 1000 ne); równik i uniwersalne astrolabium niezależne od szerokości geograficznej autorstwa Al-Zarqali (ok. 1015 r.) ; astronomiczne komputery analogowe innych średniowiecznych muzułmańskich astronomów i inżynierów; oraz astronomiczna wieża zegarowa Su Song (1094) w czasach dynastii Song . Zegar zamkowy , mechaniczny zegar astronomiczny z napędem wodnym , wynaleziony przez Ismaila al-Jazariego w 1206 roku, był pierwszym programowalnym komputer analogowy. [ kwestionowane (dla: Cytowane źródło nie potwierdza twierdzenia, a twierdzenie jest mylące.) ] Ramon Llull wynalazł Lullian Circle: hipotetyczną maszynę do obliczania odpowiedzi na pytania filozoficzne (w tym przypadku związane z chrześcijaństwem ) za pomocą kombinatoryki logicznej. Pomysł ten został podjęty przez Leibniza wieki później i dlatego jest jednym z elementów założycielskich informatyki i informatyki .

Renesansowe narzędzia obliczeniowe

Szkocki matematyk i fizyk John Napier odkrył, że mnożenie i dzielenie liczb można wykonać odpowiednio przez dodawanie i odejmowanie logarytmów tych liczb. Tworząc pierwsze tablice logarytmiczne, Napier musiał wykonać wiele żmudnych mnożeń. W tym momencie zaprojektował swoje „ Kości Napiera ”, urządzenie przypominające liczydło, które znacznie uprościło obliczenia obejmujące mnożenie i dzielenie.

Ponieważ liczby rzeczywiste można przedstawić jako odległości lub odstępy na linii, suwak logarytmiczny został wynaleziony w latach dwudziestych XVII wieku, wkrótce po pracy Napiera, aby umożliwić wykonywanie operacji mnożenia i dzielenia znacznie szybciej niż było to wcześniej możliwe. Edmund Gunter zbudował urządzenie liczące z pojedynczą skalą logarytmiczną na Uniwersytecie Oksfordzkim . Jego urządzenie znacznie uprościło obliczenia arytmetyczne, w tym mnożenie i dzielenie. Williama Oughtreda znacznie poprawił to w 1630 roku dzięki swojemu okrągłemu suwakowi logarytmicznemu. Podążył za tym z nowoczesnym suwakiem logarytmicznym w 1632 r., Zasadniczo będącym kombinacją dwóch reguł Guntera , trzymanych razem za pomocą rąk. Suwaki logarytmiczne były używane przez pokolenia inżynierów i innych specjalistów zajmujących się matematyką, aż do wynalezienia kalkulatora kieszonkowego .

Kalkulatory mechaniczne

W 1609 roku Guidobaldo del Monte skonstruował mechaniczny mnożnik do obliczania ułamków stopnia. W oparciu o system czterech kół zębatych obrót indeksu w jednym kwadrancie odpowiada 60 obrotom innego indeksu w przeciwległym kwadrancie. Dzięki tej maszynie można uniknąć błędów w obliczaniu pierwszego, drugiego, trzeciego i ćwierć stopnia. Guidobaldo jako pierwszy udokumentował użycie kół zębatych do obliczeń mechanicznych.

Wilhelm Schickard , niemiecki erudyta , zaprojektował w 1623 roku maszynę liczącą, która łączyła zmechanizowaną formę prętów Napiera z pierwszą na świecie mechaniczną maszyną sumującą wbudowaną w podstawę. Ponieważ wykorzystywał jednozębną przekładnię, zdarzały się sytuacje, w których jego mechanizm nośny zacinał się. Pożar zniszczył co najmniej jedną z maszyn w 1624 roku i uważa się, że Schickard był zbyt zniechęcony, by zbudować kolejną.

W 1642 roku, będąc jeszcze nastolatkiem, Blaise Pascal rozpoczął pionierskie prace nad maszynami liczącymi, a po trzech latach wysiłków i 50 prototypach wynalazł kalkulator mechaniczny . Zbudował dwadzieścia takich maszyn (zwanych kalkulatorem Pascala lub Pascaline) w ciągu następnych dziesięciu lat. Zachowało się dziewięć Pascaline, z których większość znajduje się w muzeach europejskich. Toczy się ciągła debata na temat tego, czy Schickarda czy Pascala należy uważać za „wynalazcę kalkulatora mechanicznego”, a zakres kwestii, które należy wziąć pod uwagę, omówiono gdzie indziej.

Gottfried Wilhelm von Leibniz wynalazł schodkowy licznik i swój słynny schodkowy mechanizm bębnowy około 1672 roku. Próbował stworzyć maszynę, której można by używać nie tylko do dodawania i odejmowania, ale używałaby ruchomego wózka do mnożenia i dzielenia. Leibniz powiedział kiedyś: „Niegodne jest, aby wspaniali ludzie tracili godziny jak niewolnicy na kalkulację, którą można by bezpiecznie przenieść na kogokolwiek innego, gdyby używano maszyn”. Jednak Leibniz nie zastosował w pełni udanego mechanizmu przenoszenia. Leibniz opisał również binarny system liczbowy , centralny składnik wszystkich nowoczesnych komputerów. Jednak do lat 40. XX wieku wiele późniejszych konstrukcji (m.in. maszyny Charlesa Babbage'a z 1822 r., a nawet ENIAC z 1945 r.) opierało się na systemie dziesiętnym.

Około 1820 roku Charles Xavier Thomas de Colmar stworzył coś, co przez resztę stulecia stało się pierwszym odnoszącym sukcesy, produkowanym masowo kalkulatorem mechanicznym, Thomas Arithmometer . Można go było używać do dodawania i odejmowania, a za pomocą ruchomego wózka operator mógł również mnożyć i dzielić w procesie długiego mnożenia i długiego dzielenia. Wykorzystywał schodkowy bęben podobny w koncepcji do tego wynalezionego przez Leibniza. Kalkulatory mechaniczne były używane do lat 70. XX wieku.

Przetwarzanie danych z kart perforowanych

W 1804 roku francuski tkacz Joseph Marie Jacquard opracował krosno , w którym tkany wzór był kontrolowany za pomocą papierowej taśmy zbudowanej z perforowanych kart . Taśmę papierową można było zmienić bez zmiany konstrukcji mechanicznej krosna. Było to przełomowe osiągnięcie w programowalności. Jego maszyna była ulepszeniem w stosunku do podobnych krosien tkackich. Karty perforowane poprzedzone były banderolami, jak w maszynie zaproponowanej przez Basile'a Bouchona . Te pasma zainspirowałyby nagrywanie informacji dla automatycznych pianin, a ostatnio obrabiarek sterowanych numerycznie .

Pod koniec lat osiemdziesiątych XIX wieku Amerykanin Herman Hollerith wynalazł przechowywanie danych na kartach perforowanych , które następnie mogły być odczytywane przez maszynę. Aby przetworzyć te dziurkowane karty, wynalazł tabulator i maszynę do dziurkowania . Jego maszyny wykorzystywały przekaźniki i liczniki elektromechaniczne . Metoda Holleritha została wykorzystana w spisie powszechnym Stanów Zjednoczonych z 1890 roku . Ten spis został przeprowadzony dwa lata szybciej niż poprzedni spis. Firma Holleritha ostatecznie stała się rdzeniem IBM .

Do 1920 roku elektromechaniczne maszyny do tworzenia tabel mogły dodawać, odejmować i drukować skumulowane sumy. Sterowanie funkcjami maszyny odbywało się poprzez umieszczanie dziesiątek drucianych zworek w wyjmowanych panelach sterowania . Kiedy w 1935 roku w Stanach Zjednoczonych ustanowiono Ubezpieczenia Społeczne , systemy kart perforowanych IBM były używane do przetwarzania danych 26 milionów pracowników. Karty perforowane stały się wszechobecne w przemyśle i administracji w księgowości i administracji.

Lesliego Comrie na temat metod kart perforowanych i publikacja WJ Eckerta pt . Punched Card Methods in Scientific Computation w 1940 r. Opisywały techniki kart perforowanych wystarczająco zaawansowane do rozwiązywania niektórych równań różniczkowych lub wykonywania mnożenia i dzielenia przy użyciu reprezentacji zmiennoprzecinkowych, wszystkie na kartach perforowanych i maszynach do zapisu jednostkowego . Takie maszyny były używane podczas II wojny światowej do kryptograficznego przetwarzania statystycznego, a także do wielu zastosowań administracyjnych. Biuro Obliczeń Astronomicznych Uniwersytetu Columbia , wykonał obliczenia astronomiczne reprezentujące najnowocześniejszy stan techniki komputerowej .

Kalkulatory

W XX wieku wcześniejsze kalkulatory mechaniczne, kasy fiskalne, maszyny księgowe itp. Zostały przeprojektowane tak, aby wykorzystywały silniki elektryczne, z położeniem przekładni jako reprezentacją stanu zmiennej. Słowo "komputer" było tytułem zawodowym przypisywanym przede wszystkim kobietom, które używały tych kalkulatorów do wykonywania obliczeń matematycznych. W latach dwudziestych XX wieku brytyjski naukowiec Lewis Fry Richardson , zainteresowany przewidywaniem pogody, skłonił go do zaproponowania ludzkich komputerów i analizy numerycznej do modelowania pogody; do dziś najpotężniejsze komputery na Ziemi są potrzebne do odpowiedniego modelowania pogody za pomocą równań Naviera – Stokesa .

Firmy takie jak Friden , Marchant Calculator i Monroe produkowały mechaniczne kalkulatory stacjonarne z lat 30. XX wieku, które potrafiły dodawać, odejmować, mnożyć i dzielić. W 1948 roku Curta został wprowadzony przez austriackiego wynalazcę Curta Herzstarka . Był to mały, ręcznie obracany mechaniczny kalkulator i jako taki był potomkiem Stepped Reckoner Gottfrieda Leibniza i Arithmometer Thomasa .

Pierwszym na świecie w pełni elektronicznym kalkulatorem biurkowym był brytyjski Bell Punch ANITA , wydany w 1961 roku. W swoich obwodach wykorzystywał lampy próżniowe , lampy z zimną katodą i Dekatrony , a do wyświetlacza zastosowano 12 lamp z zimną katodą „Nixie” . ANITA sprzedawała się dobrze , ponieważ była jedynym dostępnym elektronicznym kalkulatorem biurkowym, była cicha i szybka. Technologia lampowa została zastąpiona w czerwcu 1963 roku przez firmę Friden wyprodukowaną w USA EC-130, który miał konstrukcję całkowicie tranzystorową, stos czterech 13-cyfrowych liczb wyświetlanych na 5-calowym (13 cm) CRT i wprowadził odwróconą notację polską (RPN).

Pierwsze urządzenie komputerowe ogólnego przeznaczenia

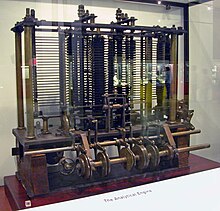

Charles Babbage , angielski inżynier mechanik i erudyta , zapoczątkował koncepcję programowalnego komputera. Uważany za „ ojca komputera ”, wymyślił i wynalazł pierwszy komputer mechaniczny na początku XIX wieku. Po pracy nad swoim rewolucyjnym silnikiem różnicowym , zaprojektowanym do pomocy w obliczeniach nawigacyjnych, w 1833 roku zdał sobie sprawę, że możliwy jest znacznie bardziej ogólny projekt, silnik analityczny . Wejście programów i danych miało być dostarczane do maszyny za pomocą kart perforowanych , metoda używana w tamtym czasie do kierowania krosnami mechanicznymi , takimi jak krosno żakardowe . Na wyjściu maszyna miałaby drukarkę, ploter krzywych i dzwonek. Maszyna byłaby również w stanie dziurkować numery na kartach do późniejszego wczytania. Wykorzystywał zwykłą arytmetykę stałoprzecinkową o podstawie 10 .

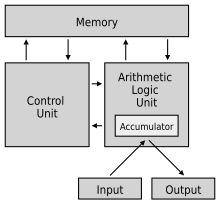

Silnik zawierał jednostkę logiki arytmetycznej , przepływ sterowania w postaci warunkowych rozgałęzień i pętli oraz zintegrowaną pamięć , co czyni go pierwszym projektem komputera ogólnego przeznaczenia, który można by opisać współczesnymi terminami jako Turing-complete .

Miał istnieć magazyn, czyli pamięć, zdolna pomieścić 1000 liczb po 40 cyfr każda (ok. 16,7 kB ). Jednostka arytmetyczna , zwana „młynem”, byłaby w stanie wykonać wszystkie cztery operacje arytmetyczne , a także porównania i opcjonalnie pierwiastki kwadratowe . Początkowo był pomyślany jako silnik różnicowy zakrzywiony do tyłu, w ogólnie okrągłym układzie, z długim sklepem wychodzącym z jednej strony. (Późniejsze rysunki przedstawiają regularny układ siatki). Podobnie jak jednostka centralna (CPU) w nowoczesnym komputerze młyn polegałby na własnych procedurach wewnętrznych, mniej więcej odpowiednikach mikrokodu we współczesnych procesorach, które byłyby przechowywane w postaci kołków włożonych w obracające się bębny zwane „beczkami”, w celu wykonania niektórych bardziej złożone instrukcje, które może określać program użytkownika.

Język programowania używany przez użytkowników był podobny do współczesnych języków asemblera . Możliwe były pętle i rozgałęzienia warunkowe, więc język w takiej postaci, w jakiej został pomyślany, byłby kompletny według Turinga , jak później zdefiniował go Alan Turing . Zastosowano trzy różne typy kart perforowanych: jedną do operacji arytmetycznych, jedną do stałych liczbowych i jedną do operacji ładowania i przechowywania, przenosząc liczby z magazynu do jednostki arytmetycznej lub z powrotem. Były trzy oddzielne czytniki dla trzech typów kart.

Maszyna wyprzedzała swoje czasy o około sto lat. Jednak projekt został spowolniony przez różne problemy, w tym spory z głównym mechanikiem budującym jego części. Wszystkie części do jego maszyny musiały być wykonane ręcznie — był to poważny problem dla maszyny składającej się z tysięcy części. Ostatecznie projekt został rozwiązany decyzją rządu brytyjskiego o zaprzestaniu finansowania. Niepowodzenie Babbage'a w ukończeniu silnika analitycznego można przypisać głównie trudnościom nie tylko politycznym i finansowym, ale także jego pragnieniu opracowania coraz bardziej wyrafinowanego komputera i posuwania się naprzód szybciej, niż ktokolwiek inny byłby w stanie nadążyć. Adę Lovelace przetłumaczył i dodał uwagi do „ Szkicu silnika analitycznego ” Luigiego Federico Menabrei . Wydaje się, że jest to pierwszy opublikowany opis programowania, więc Ada Lovelace jest powszechnie uważana za pierwszego programistę komputerowego.

Za Babbage'em, choć początkowo nieświadomym jego wcześniejszej pracy, podążał Percy Ludgate , urzędnik handlarza kukurydzą w Dublinie w Irlandii. Niezależnie zaprojektował programowalny komputer mechaniczny, który opisał w pracy opublikowanej w 1909 roku. Dwóch innych wynalazców, Leonardo Torres y Quevedo i Vannevar Bush , również śledziło badania oparte na pracy Babbage'a. W swoich Essays on Automatics (1913) Torres y Quevedo zaprojektował maszynę liczącą typu Babbage'a, która wykorzystywała części elektromechaniczne, które zawierały liczbę zmiennoprzecinkową reprezentacji i zbudował wczesny prototyp w 1920 r. W artykule Busha Instrumental Analysis (1936) omówiono wykorzystanie istniejących maszyn dziurkowanych IBM do wdrożenia projektu Babbage'a. W tym samym roku rozpoczął projekt Rapid Arithmetic Machine w celu zbadania problemów związanych z budową elektronicznego komputera cyfrowego.

Komputery analogowe

W pierwszej połowie XX wieku komputery analogowe przez wielu uważane były za przyszłość informatyki. Urządzenia te wykorzystywały stale zmieniające się aspekty zjawisk fizycznych, takie jak elektryczne , mechaniczne lub hydrauliczne , do modelowania rozwiązywanego problemu, w przeciwieństwie do komputerów cyfrowych które symbolicznie reprezentowały różne wielkości, gdy zmieniają się ich wartości liczbowe. Ponieważ komputer analogowy nie używa wartości dyskretnych, ale raczej wartości ciągłe, procesów nie można niezawodnie powtarzać z dokładną równoważnością, tak jak w przypadku maszyn Turinga .

Pierwszym nowoczesnym komputerem analogowym była maszyna do przewidywania pływów , wynaleziona przez Sir Williama Thomsona , późniejszego Lorda Kelvina, w 1872 roku. Używała systemu kół pasowych i drutów do automatycznego obliczania przewidywanych poziomów pływów dla określonego okresu w określonym miejscu i była doskonałe narzędzie do nawigacji na płytkich wodach. Jego urządzenie było podstawą dalszego rozwoju komputerów analogowych.

Analizator różniczkowy , mechaniczny komputer analogowy przeznaczony do rozwiązywania równań różniczkowych poprzez całkowanie przy użyciu mechanizmów koła i dysku, został opracowany w 1876 roku przez Jamesa Thomsona , brata bardziej znanego Lorda Kelvina. Zbadał możliwą konstrukcję takich kalkulatorów, ale przeszkodził mu ograniczony wyjściowy moment obrotowy integratorów kulowo-tarczowych . W analizatorze różniczkowym wyjście jednego integratora sterowało wejściem następnego integratora lub wyjściem graficznym.

Ważnym postępem w dziedzinie komputerów analogowych było opracowanie pierwszych systemów kierowania ogniem dla okrętów artyleryjskich dalekiego zasięgu . Kiedy zasięg artylerii dramatycznie wzrósł pod koniec XIX wieku, obliczenie właściwego punktu celowania nie było już prostą sprawą, biorąc pod uwagę czas lotu pocisków. Różni obserwatorzy na pokładzie statku przekazywali pomiary odległości i obserwacje do centralnej stacji kreślarskiej. Tam zespoły kierowania ogniem informowały o lokalizacji, prędkości i kierunku statku oraz jego celu, a także o różnych korektach efektu Coriolisa , wpływ pogody na powietrze i inne korekty; komputer wyprowadzałby wtedy rozwiązanie strzelania, które byłoby podawane do wieżyczek w celu ułożenia. W 1912 roku brytyjski inżynier Arthur Pollen opracował pierwszy zasilany elektrycznie mechaniczny komputer analogowy (zwany wówczas zegarem Argo). [ potrzebne źródło ] Był używany przez Cesarską Marynarkę Wojenną Rosji podczas I wojny światowej . [ potrzebne źródło ] Alternatywna tabela Dreyera system kierowania ogniem został zamontowany na brytyjskich okrętach kapitałowych do połowy 1916 roku.

Urządzenia mechaniczne były również używane do wspomagania dokładności bombardowań z powietrza . Drift Sight był pierwszą tego typu pomocą, opracowaną przez Harry'ego Wimperisa w 1916 roku dla Royal Naval Air Service ; zmierzył prędkość wiatru z powietrza i wykorzystał ten pomiar do obliczenia wpływu wiatru na trajektorię bomb. System został później ulepszony za pomocą celownika bombowego Course Setting Bomb Sight i osiągnął punkt kulminacyjny dzięki celownikom bombowym z II wojny światowej , celownikowi bombowemu Mark XIV ( RAF Bomber Command ) i Norden ( Siły Powietrzne Armii Stanów Zjednoczonych ).

Sztuka mechanicznych obliczeń analogowych osiągnęła apogeum wraz z analizatorem różnicowym , zbudowanym przez HL Hazena i Vannevara Busha w MIT począwszy od 1927 roku, który opierał się na mechanicznych integratorach Jamesa Thomsona i wzmacniaczach momentu wynalezionych przez HW Niemana. Tuzin z tych urządzeń zostało zbudowanych, zanim ich przestarzałość stała się oczywista; najpotężniejszy został zbudowany w Moore School of Electrical Engineering na Uniwersytecie Pensylwanii , gdzie zbudowano ENIAC .

W pełni elektroniczny komputer analogowy został zbudowany przez Helmuta Hölzera w 1942 roku w Peenemünde Army Research Center .

W latach pięćdziesiątych sukces cyfrowych komputerów elektronicznych oznaczał koniec większości analogowych maszyn obliczeniowych, ale hybrydowe komputery analogowe , kontrolowane przez elektronikę cyfrową, pozostawały w znacznym użyciu do lat pięćdziesiątych i sześćdziesiątych XX wieku, a później w niektórych specjalistycznych zastosowaniach.

Pojawienie się komputera cyfrowego

Zasada działania współczesnego komputera została po raz pierwszy opisana przez informatyka Alana Turinga , który przedstawił tę ideę w swoim przełomowym artykule z 1936 r., On Computable Numbers . Turing przeformułował Kurta Gödla z 1931 r. dotyczące granic dowodu i obliczeń, zastępując uniwersalny formalny język Gödla oparty na arytmetyce formalnymi i prostymi hipotetycznymi urządzeniami, które stały się znane jako maszyny Turinga . Udowodnił, że taka maszyna byłaby zdolna do wykonywania dowolnych obliczeń matematycznych, gdyby można ją było przedstawić jako algorytm . Następnie udowodnił, że nie ma rozwiązania problemu Entscheidungs, pokazując najpierw, że problem zatrzymania maszyn Turinga jest nierozstrzygalny : generalnie nie można algorytmicznie zdecydować, czy dana maszyna Turinga kiedykolwiek się zatrzyma.

Wprowadził również pojęcie „uniwersalnej maszyny” (obecnie znanej jako uniwersalna maszyna Turinga ), z ideą, że taka maszyna może wykonywać zadania dowolnej innej maszyny, czyli innymi słowy, jest w stanie udowodnić, że jest w stanie obliczyć wszystko, co jest obliczalny poprzez wykonanie programu zapisanego na taśmie, co pozwala na programowanie maszyny. Von Neumann przyznał, że główna koncepcja współczesnego komputera wynika z tego artykułu. Maszyny Turinga są do dziś centralnym przedmiotem badań w teorii obliczeń . Z wyjątkiem ograniczeń narzuconych przez ich ograniczone zasoby pamięci, nowoczesne komputery są uważane za kompletne według Turinga , co oznacza, że mają zdolność wykonywania algorytmów równoważną uniwersalnej maszynie Turinga .

Komputery elektromechaniczne

Era nowoczesnych komputerów rozpoczęła się gwałtownym rozwojem przed II wojną światową iw jej trakcie. Większość komputerów cyfrowych zbudowanych w tym okresie była elektromechaniczna - przełączniki elektryczne napędzały mechaniczne przekaźniki do wykonywania obliczeń. Urządzenia te miały niską prędkość roboczą i ostatecznie zostały zastąpione przez znacznie szybsze komputery całkowicie elektryczne, pierwotnie wykorzystujące lampy próżniowe .

Z2 był jednym z najwcześniejszych przykładów elektromechanicznego komputera przekaźnikowego i został stworzony przez niemieckiego inżyniera Konrada Zuse w 1940 roku . Był ulepszeniem jego wcześniejszego Z1 ; chociaż wykorzystywał tę samą pamięć mechaniczną , zastąpił logikę arytmetyczną i sterującą elektrycznymi obwodami przekaźnikowymi .

kryptolodzy zbudowali urządzenia elektromechaniczne zwane bombami , aby pomóc rozszyfrować tajne wiadomości zaszyfrowane przez niemiecką maszynę Enigma podczas II wojny światowej . Początkowy projekt bomby został stworzony w 1939 roku przez Alana Turinga w UK Government Code and Cypher School (GC&CS) w Bletchley Park , z ważnym udoskonaleniem opracowanym w 1940 roku przez Gordona Welchmana . Projekt techniczny i konstrukcja była dziełem Harolda Keena z brytyjskiej firmy Tabulating Machine Company . Był to znaczny postęp w stosunku do urządzenia, które zostało zaprojektowane w 1938 roku przez kryptologa Polskiego Biura Szyfrów Mariana Rejewskiego i znane jako „ bomba kryptologiczna ” ( pol . „bomba kryptologiczna” ).

W 1941 roku Zuse kontynuował swoją wcześniejszą maszynę, wprowadzając Z3 , pierwszy na świecie działający elektromechaniczny programowalny , w pełni automatyczny komputer cyfrowy. Z3 został zbudowany z 2000 przekaźników , realizując 22- bitowe słowo , które działało z częstotliwością zegara około 5–10 Hz . Kod programu i dane zostały zapisane na perforowanej folii . Pod pewnymi względami był dość podobny do nowoczesnych maszyn, będąc pionierem wielu postępów, takich jak liczby zmiennoprzecinkowe . Zastąpienie trudnego do wdrożenia systemu dziesiętnego (używanego we Charlesa Babbage'a ) prostszym systemem binarnym oznaczało, że maszyny Zuse były łatwiejsze w budowie i potencjalnie bardziej niezawodne, biorąc pod uwagę dostępne wówczas technologie. W 1998 roku Raúl Rojas udowodnił, że Z3 był maszyną kompletną według Turinga . W dwóch patentowych z 1936 roku Zuse przewidział również, że instrukcje maszynowe mogą być przechowywane w tej samej pamięci, co dane — kluczowy wgląd w to, co stało się znane jako architektura von Neumanna , po raz pierwszy wdrożony w 1948 roku w Ameryce w elektromechanicznym IBM SSEC oraz w Wielkiej Brytanii we w pełni elektronicznym Manchester Baby .

Zuse doznał niepowodzeń podczas II wojny światowej, kiedy niektóre z jego maszyn zostały zniszczone w trakcie bombardowań alianckich . Najwyraźniej jego praca pozostawała w dużej mierze nieznana inżynierom w Wielkiej Brytanii i Stanach Zjednoczonych znacznie później, chociaż przynajmniej IBM był tego świadomy, ponieważ sfinansował jego powojenny start-up w 1946 roku w zamian za opcję na patenty Zuse.

W 1944 roku w laboratoriach IBM Endicott skonstruowano Harvard Mark I. Był to komputer elektromechaniczny ogólnego przeznaczenia podobny do Z3, ale nie był w pełni kompletny pod względem Turinga.

Obliczenia cyfrowe

Termin cyfrowy został po raz pierwszy zaproponowany przez George'a Roberta Stibitza i odnosi się do sytuacji, w których sygnał, taki jak napięcie, nie jest używany do bezpośredniego przedstawiania wartości (jak w komputerze analogowym ), ale do jej kodowania. W listopadzie 1937 r. Stibitz, wówczas pracujący w Bell Labs (1930–1941), ukończył kalkulator przekaźnikowy, który później nazwał „Modelem K ” (od „ stół kuchenny ”, na którym go zmontował), który stał się pierwszy sumator binarny . Zazwyczaj sygnały mają dwa stany – niski (zwykle reprezentujący 0) i wysoki (zwykle reprezentujący 1), ale czasami logika trójwartościowa , zwłaszcza w pamięci o dużej gęstości. Nowoczesne komputery na ogół używają logiki binarnej , ale wiele wczesnych maszyn było komputerami dziesiętnymi . W tych maszynach podstawową jednostką danych była cyfra dziesiętna, zakodowana w jednym z kilku schematów, w tym dziesiętny kodowany binarnie lub BCD, bi-quinary , nadmiar-3 i kod dwa z pięciu .

Matematyczną podstawą obliczeń cyfrowych jest algebra Boole'a , opracowana przez brytyjskiego matematyka George'a Boole'a w jego pracy The Laws of Thought , opublikowanej w 1854 roku. Jego algebra Boole'a została udoskonalona w latach 60. XIX wieku przez Williama Jevonsa i Charlesa Sandersa Peirce'a i została po raz pierwszy zaprezentowana systematycznie przez Ernsta Schrödera i AN Whiteheada . W 1879 Gottlob Frege rozwija formalne podejście do logiki i proponuje pierwszy język logiki dla równań logicznych.

W latach trzydziestych XX wieku, pracując niezależnie, amerykański inżynier elektronik Claude Shannon i radziecki logik Wiktor Szestakow wykazali bezpośrednią zgodność między koncepcjami logiki boolowskiej a niektórymi obwodami elektrycznymi, zwanymi obecnie bramkami logicznymi , które są obecnie wszechobecne w komputerach cyfrowych. Pokazali, że elektroniczne przekaźniki i przełączniki mogą realizować wyrażenia algebry Boole'a . Teza ta zasadniczo założyła praktyczny obwód cyfrowy projekt. Ponadto artykuł Shannona zawiera poprawny schemat obwodu dla 4-bitowego cyfrowego sumatora binarnego.

Przetwarzanie danych elektronicznych

Czysto elektroniczne elementy obwodów wkrótce zastąpiły swoje mechaniczne i elektromechaniczne odpowiedniki, jednocześnie cyfrowa kalkulacja zastąpiła analogową. Maszyny takie jak Z3 , komputer Atanasoff-Berry , komputery Colossus i ENIAC były budowane ręcznie, przy użyciu obwodów zawierających przekaźniki lub zawory (lampy próżniowe) i często używały perforowanych kart lub perforowanej taśmy papierowej do wprowadzania i jako główne (nieulotny) nośnik pamięci.

Inżynier Tommy Flowers dołączył do oddziału telekomunikacyjnego Poczty Głównej w 1926 roku. Pracując w stacji badawczej w Dollis Hill w latach 30. zaczął badać możliwości wykorzystania elektroniki w centrali telefonicznej . Eksperymentalny sprzęt, który zbudował w 1934 roku, zaczął działać 5 lat później, przekształcając część sieci centrali telefonicznej w elektroniczny system przetwarzania danych, wykorzystujący tysiące lamp próżniowych .

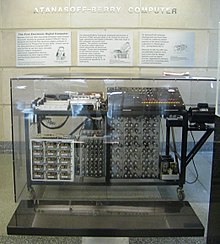

W Stanach Zjednoczonych w 1940 roku Arthur Dickinson (IBM) wynalazł pierwszy cyfrowy komputer elektroniczny. To urządzenie liczące było w pełni elektroniczne – sterowanie, obliczenia i wyjście (pierwszy wyświetlacz elektroniczny). John Vincent Atanasoff i Clifford E. Berry z Iowa State University opracowali Atanasoff-Berry Computer (ABC) w 1942 roku, pierwsze binarne elektroniczne cyfrowe urządzenie liczące. Ten projekt był półelektroniczny (sterowanie elektromechaniczne i obliczenia elektroniczne) i wykorzystywał około 300 lamp próżniowych z kondensatorami zamocowanymi w mechanicznie obracającym się bębnie dla pamięci. Jednak jego czytnik / czytnik kart papierowych był zawodny, a regeneracyjny system kontaktowy bębna był mechaniczny. Specyficzny charakter maszyny i brak wymiennych, przechowywany program odróżnia go od nowoczesnych komputerów.

Komputery, których logika została zbudowana głównie przy użyciu lamp próżniowych, są obecnie znane jako komputery pierwszej generacji .

Elektroniczny programowalny komputer

Podczas II wojny światowej brytyjscy łamacze szyfrów w Bletchley Park , 64 km na północ od Londynu, odnieśli szereg sukcesów w łamaniu zaszyfrowanej komunikacji wojskowej wroga. Niemiecka maszyna szyfrująca, Enigma , została po raz pierwszy zaatakowana przy pomocy bomb elektromechanicznych . Kobiety często obsługiwały te maszyny bombowe. Wykluczyli możliwe ustawienia Enigmy, wykonując łańcuchy dedukcji logicznych zaimplementowanych elektrycznie. Większość możliwości prowadziła do sprzeczności, a kilka pozostałych można było przetestować ręcznie.

Niemcy opracowali również szereg systemów szyfrowania dalekopisów, zupełnie odmiennych od Enigmy. Maszyna Lorenz SZ 40/42 była używana do łączności wojskowej wysokiego szczebla, o kryptonimie „Tunny” przez Brytyjczyków. Pierwsze przechwytywanie wiadomości Lorenza rozpoczęło się w 1941 roku. W ramach ataku na Tunny, Max Newman i jego współpracownicy opracowali Heath Robinson , maszynę o stałej funkcji, pomagającą w łamaniu szyfrów. Tommy Flowers , starszy inżynier w Post Office Research Station został polecony Maxowi Newmanowi przez Alana Turinga i spędził jedenaście miesięcy od początku lutego 1943 roku projektując i budując bardziej elastyczny komputer Colossus (który zastąpił Heath Robinson ). Po teście funkcjonalnym w grudniu 1943 roku Colossus został wysłany do Bletchley Park, gdzie został dostarczony 18 stycznia 1944 roku i zaatakował swoją pierwszą wiadomość 5 lutego.

Colossus był pierwszym na świecie elektronicznym cyfrowym programowalnym komputerem . Używał dużej liczby zaworów (lamp próżniowych). Miał wejście na taśmę papierową i można go było skonfigurować do wykonywania różnych logicznych operacji boolowskich na swoich danych, ale nie był kompletny Turinga . Wprowadzanie danych do Colossusa odbywało się za pomocą fotoelektrycznego odczytanie transkrypcji z taśmy papierowej zaszyfrowanej przechwyconej wiadomości. Zostało to ułożone w ciągłą pętlę, aby można było je wielokrotnie odczytywać i ponownie odczytywać - nie było wewnętrznego magazynu danych. Mechanizm odczytu działał z prędkością 5000 znaków na sekundę, a taśma papierowa poruszała się z prędkością 40 stóp / s (12,2 m / s; 27,3 mil / h). Colossus Mark 1 zawierał 1500 zaworów termionowych (rurek), ale Mark 2 z 2400 zaworami i pięcioma procesorami połączonymi równolegle był 5 razy szybszy i prostszy w obsłudze niż Mark 1, znacznie przyspieszając proces dekodowania. Mark 2 został zaprojektowany podczas budowy Mark 1. Allena Coombsa przejął kierownictwo nad projektem Colossus Mark 2, kiedy Tommy Flowers zajął się innymi projektami. Pierwszy Mark 2 Colossus zaczął działać 1 czerwca 1944 r., w samą porę przed aliancką inwazją na Normandię w D-Day .

Większość zastosowań Colossusa polegała na określaniu pozycji początkowych wirników Tunny dla wiadomości, którą nazywano „ustawieniem kół”. Colossus po raz pierwszy w historii wykorzystał rejestry przesuwne i tablice skurczowe , umożliwiając pięć jednoczesnych testów, z których każdy obejmował do 100 obliczeń boolowskich . Umożliwiło to zbadanie pięciu różnych możliwych pozycji początkowych dla jednego przejścia taśmy papierowej. Oprócz ustawiania kół, niektóre późniejsze Colossi zawierały mechanizmy mające pomóc w określeniu wzorów kołków, znanych jako „łamanie koła”. Oba modele były programowalne za pomocą przełączników i paneli wtyczek w sposób, w jaki ich poprzednicy nie byli. Do końca wojny działało dziesięć kolosów Mk 2.

Bez użycia tych maszyn alianci byliby pozbawieni bardzo cennych informacji wywiadowczych , które uzyskano dzięki odczytaniu ogromnej ilości zaszyfrowanych wiadomości telegraficznych wysokiego szczebla między niemieckim Naczelnym Dowództwem (OKW) a dowództwem ich armii w całej okupowanej Europie. Szczegóły ich istnienia, projektu i zastosowania były utrzymywane w tajemnicy aż do lat 70. Winstona Churchilla osobiście wydał rozkaz zniszczenia ich na kawałki nie większe niż ludzka dłoń, aby zachować w tajemnicy, że Brytyjczycy byli w stanie złamać szyfry Lorenza SZ (z niemieckich maszyn szyfrujących typu rotor stream) podczas nadchodzącej zimnej wojny. Dwie maszyny zostały przeniesione do nowo utworzonego GCHQ , a pozostałe zostały zniszczone. W rezultacie maszyny nie zostały uwzględnione w wielu historiach informatyki. Zrekonstruowana kopia robocza jednej z maszyn Colossus jest obecnie wystawiana w Bletchley Park.

Zbudowany w USA ENIAC (Electronic Numerical Integrator and Computer) był pierwszym elektronicznym programowalnym komputerem zbudowanym w USA. Chociaż ENIAC był podobny do Colossusa, był znacznie szybszy i bardziej elastyczny. Było to jednoznacznie kompletne urządzenie Turinga i mogło obliczyć dowolny problem, który zmieściłby się w jego pamięci. Podobnie jak Colossus, „program” w ENIAC był definiowany przez stany jego kabli krosowych i przełączników, co jest dalekie od zapisanego programu maszyny elektroniczne, które pojawiły się później. Po napisaniu programu należało go mechanicznie ustawić w maszynie z ręcznym resetowaniem wtyczek i przełączników. Programistkami ENIAC były kobiety, które zostały wyszkolone jako matematyczki.

Łączył dużą szybkość elektroniki z możliwością programowania dla wielu złożonych problemów. Mogła dodawać lub odejmować 5000 razy na sekundę, tysiąc razy szybciej niż jakakolwiek inna maszyna. Miał również moduły do mnożenia, dzielenia i pierwiastkowania kwadratowego. Szybka pamięć była ograniczona do 20 słów (co odpowiada około 80 bajtom). Zbudowany pod kierownictwem Johna Mauchly'ego i J. Prespera Eckerta z University of Pennsylvania, rozwój i budowa ENIAC trwała od 1943 roku do pełnego uruchomienia pod koniec 1945 roku. Maszyna była ogromna, ważyła 30 ton, zużywała 200 kilowatów energii elektrycznej i zawierał ponad 18 000 lamp próżniowych, 1500 przekaźników i setki tysięcy rezystorów, kondensatorów i cewek indukcyjnych. Jednym z jego głównych osiągnięć inżynieryjnych było zminimalizowanie skutków wypalenia rur, co było powszechnym problemem w niezawodności maszyn w tamtych czasach. Maszyna była w niemal ciągłym użyciu przez następne dziesięć lat.

Komputer z zapisanym programem

Wczesne maszyny komputerowe wykonywały ustaloną sekwencję kroków, zwaną „programem” , który można było zmienić, zmieniając połączenia elektryczne za pomocą przełączników lub panelu krosowego (lub tablicy wtykowej ). Jednak ten proces „przeprogramowania” był często trudny i czasochłonny, wymagając od inżynierów tworzenia schematów blokowych i fizycznego ponownego okablowania maszyn. Z kolei komputery z przechowywanymi programami zostały zaprojektowane do przechowywania zestawu instrukcji (programu ) w pamięci - zwykle w tej samej pamięci, co przechowywane dane.

Teoria

Teoretyczne podstawy dla komputera z zapisanym programem zostały zaproponowane przez Alana Turinga w jego artykule z 1936 roku. W 1945 roku Turing dołączył do Narodowego Laboratorium Fizycznego i rozpoczął pracę nad opracowaniem elektronicznego komputera cyfrowego z przechowywanymi programami. Jego raport z 1945 r. „Proponowany kalkulator elektroniczny” był pierwszą specyfikacją takiego urządzenia.

Tymczasem John von Neumann z Moore School of Electrical Engineering , University of Pennsylvania , rozesłał swój pierwszy szkic raportu na temat EDVAC w 1945 roku. Chociaż zasadniczo podobny do projektu Turinga i zawierający stosunkowo mało szczegółów technicznych, architektura komputera, którą nakreślił, stała się znana jako „ architektura von Neumanna ”. Turing przedstawił bardziej szczegółowy dokument Narodowego Laboratorium Fizycznego (NPL) w 1946 r., podając pierwszy w miarę kompletny projekt komputer z zapisanym programem , urządzenie, które nazwał Automatic Computing Engine (ACE). Jednak bardziej znany projekt EDVAC Johna von Neumanna , który znał prace teoretyczne Turinga, zyskał większy rozgłos, pomimo jego niekompletności i wątpliwego braku podania źródła niektórych pomysłów.

Turing uważał, że szybkość i rozmiar pamięci komputera są kluczowymi elementami, dlatego zaproponował szybką pamięć o wielkości, którą dziś nazwalibyśmy 25 KB , dostępną z szybkością 1 MHz . ACE zaimplementowało podprogramów , podczas gdy EDVAC tego nie zrobiło, a ACE używało również Skróconych instrukcji komputerowych, wczesnej formy języka programowania .

Dziecko z Manchesteru

Manchester Baby (Small Scale Experimental Machine, SSEM) był pierwszym na świecie elektronicznym komputerem z zapisanym programem . Został zbudowany na Victoria University of Manchester przez Frederica C. Williamsa , Toma Kilburna i Geoffa Tootilla, a swój pierwszy program uruchomił 21 czerwca 1948 roku.

Maszyna nie miała być praktycznym komputerem, ale zamiast tego została zaprojektowana jako stanowisko testowe dla lampy Williamsa , pierwszego cyfrowego urządzenia pamięci masowej o swobodnym dostępie . Wynaleziony przez Freddiego Williamsa i Toma Kilburna na Uniwersytecie w Manchesterze w 1946 i 1947 roku, był to kineskop , który wykorzystywał efekt zwany emisją wtórną do tymczasowego przechowywania elektronicznych danych binarnych i był z powodzeniem używany w kilku wczesnych komputerach.

Opisany jako mały i prymitywny w retrospektywie z 1998 roku, Baby był pierwszą działającą maszyną zawierającą wszystkie elementy niezbędne dla nowoczesnego komputera elektronicznego. Gdy tylko okazało się, że jego projekt jest wykonalny, na uniwersytecie zainicjowano projekt mający na celu przekształcenie projektu w bardziej użyteczny komputer, Manchester Mark 1 . Z kolei Mark 1 szybko stał się prototypem Ferranti Mark 1 , pierwszego na świecie dostępnego na rynku komputera ogólnego przeznaczenia.

Dziecko miało słowo o długości 32 bitów i pamięć 32 słów. Ponieważ został zaprojektowany jako najprostszy możliwy komputer z zapisanym programem, jedynymi operacjami arytmetycznymi zaimplementowanymi sprzętowo były odejmowanie i negacja ; inne operacje arytmetyczne zostały zaimplementowane w oprogramowaniu. Pierwszy z trzech programów napisanych dla tej maszyny znalazł najwyższy właściwy dzielnik liczby 2 18 (262,144), znane obliczenie zajęłoby dużo czasu - a więc udowodniłoby niezawodność komputera - poprzez przetestowanie każdej liczby całkowitej od 2 18 - 1 w dół, ponieważ dzielenie było realizowane przez wielokrotne odejmowanie dzielnika. Program składał się z 17 instrukcji i działał przez 52 minuty, zanim osiągnął poprawną odpowiedź 131 072, po wykonaniu przez Baby 3,5 miliona operacji (dla efektywnej szybkości procesora 1,1 kIPS ). Kolejne przybliżenia odpowiedzi były wyświetlane jako wzór kropek na wyjściowym CRT , który odzwierciedlał wzór trzymany na rurze Williamsa używanej do przechowywania.

Manchester Marka 1

SSEM doprowadził do rozwoju Manchester Mark 1 na Uniwersytecie w Manchesterze. Prace rozpoczęto w sierpniu 1948 r., a pierwsza wersja działała do kwietnia 1949 r.; program napisany w celu wyszukiwania liczb pierwszych Mersenne'a działał bezbłędnie przez dziewięć godzin w nocy z 16 na 17 czerwca 1949 r. Udana operacja maszyny była szeroko opisywana w prasie brytyjskiej, która używała wyrażenia „elektroniczny mózg”, opisując ją swoim czytelnicy.

Komputer ma szczególne znaczenie historyczne ze względu na pionierskie włączenie rejestrów indeksowych , innowację, która ułatwiła programowi sekwencyjne czytanie tablicy słów w pamięci. Trzydzieści cztery patenty wynikały z rozwoju maszyny, a wiele pomysłów stojących za jej projektem zostało włączonych do kolejnych produktów komercyjnych, takich jak IBM 701 i 702 , a także Ferranti Mark 1. Główni projektanci, Frederic C. Williams i Tom Kilburn , doszli do wniosku na podstawie swoich doświadczeń z Mark 1, że komputery będą częściej wykorzystywane w celach naukowych niż w czystej matematyce. W 1951 roku rozpoczęli prace rozwojowe nad Meg , następcą Mark 1, który zawierałby jednostkę zmiennoprzecinkową .

EDSAC

Innym pretendentem do miana pierwszego rozpoznawalnego nowoczesnego cyfrowego komputera z przechowywanymi programami był EDSAC , zaprojektowany i skonstruowany przez Maurice'a Wilkesa i jego zespół z University of Cambridge Mathematical Laboratory w Anglii na Uniwersytecie w Cambridge w 1949 roku. Maszyna została zainspirowana przez Johna przełomowy pierwszy szkic raportu von Neumanna na temat EDVAC i był jednym z pierwszych użytecznych elektronicznych komputerów z zapisanymi programami cyfrowymi.

EDSAC uruchomił swoje pierwsze programy 6 maja 1949 r., kiedy to obliczył tablicę kwadratów i listę liczb pierwszych . EDSAC posłużył również jako podstawa dla pierwszego komercyjnego komputera LEO I , używanego przez firmę produkującą żywność J. Lyons & Co. Ltd. EDSAC 1 został ostatecznie zamknięty 11 lipca 1958 r., Zastąpiony przez EDSAC 2, który był używany do 1965 r.

„Mózg” [komputer] może pewnego dnia zejść do naszego poziomu [zwykłych ludzi] i pomóc nam w obliczaniu podatku dochodowego i księgowości. Ale to spekulacje i na razie nic na to nie wskazuje.

— brytyjska gazeta The Star w artykule prasowym z czerwca 1949 r. o komputerze EDSAC , na długo przed erą komputerów osobistych.

EDVAC

Wynalazcy ENIAC , John Mauchly i J. Presper Eckert , zaproponowali budowę EDVAC w sierpniu 1944 r., A prace projektowe dla EDVAC rozpoczęto w Moore School of Electrical Engineering Uniwersytetu Pensylwanii , zanim ENIAC był w pełni operacyjny. W projekcie wprowadzono szereg ważnych ulepszeń architektonicznych i logicznych opracowanych podczas budowy ENIAC oraz szybką pamięć o dostępie szeregowym . Jednak Eckert i Mauchly opuścili projekt, a jego budowa upadła.

W końcu w sierpniu 1949 roku dostarczono go do Laboratorium Badań Balistycznych Armii Stanów Zjednoczonych na poligonie w Aberdeen , ale z powodu wielu problemów komputer zaczął działać dopiero w 1951 roku i to tylko w ograniczonym zakresie.

Komputery komercyjne

Pierwszym komercyjnym komputerem był Ferranti Mark 1 , zbudowany przez Ferranti i dostarczony na Uniwersytet w Manchesterze w lutym 1951 roku. Był oparty na Manchester Mark 1 . Główne ulepszenia w stosunku do Manchester Mark 1 dotyczyły rozmiaru pamięci podstawowej (przy użyciu rur Williamsa o swobodnym dostępie ), pamięci dodatkowej (przy użyciu bębna magnetycznego ), szybszy mnożnik i dodatkowe instrukcje. Podstawowy czas cyklu wynosił 1,2 milisekundy, a mnożenie można było zakończyć w około 2,16 milisekundy. Mnożnik wykorzystywał prawie jedną czwartą z 4050 lamp próżniowych (zaworów) maszyny. Druga maszyna została zakupiona przez Uniwersytet w Toronto , zanim projekt został zmieniony na Mark 1 Star . Co najmniej siedem z tych późniejszych maszyn zostało dostarczonych w latach 1953-1957, w tym jedna do Shell w Amsterdamie.

W październiku 1947 roku dyrektorzy J. Lyons & Company , brytyjskiej firmy cateringowej słynącej z herbaciarni, ale bardzo zainteresowanej nowymi technikami zarządzania biurem, postanowili wziąć aktywny udział w promowaniu komercyjnego rozwoju komputerów. Komputer LEO I (Lyons Electronic Office) zaczął działać w kwietniu 1951 roku i wykonywał pierwszą na świecie rutynową pracę komputerową w biurze . 17 listopada 1951 r. firma J. Lyons rozpoczęła cotygodniową pracę wyceny piekarni na LEO – pierwszej aplikacji biznesowej uruchomionej na komputerze z zapisanym programem.

W czerwcu 1951 roku UNIVAC I (Universal Automatic Computer) został dostarczony do US Census Bureau . Remington Rand ostatecznie sprzedał 46 maszyn po ponad 1 mln USD każda (10,4 mln USD w 2023 r.). UNIVAC był pierwszym komputerem „produkowanym masowo”. Używał 5200 lamp próżniowych i zużywał 125 kW mocy. Jego podstawową pamięcią były rtęciowe linie opóźniające z dostępem szeregowym , zdolne do przechowywania 1000 słów składających się z 11 cyfr dziesiętnych plus znak (słowa 72-bitowe).

IBM wprowadził mniejszy, bardziej przystępny cenowo komputer w 1954 roku, który okazał się bardzo popularny. IBM 650 ważył ponad 900 kg , dołączony zasilacz ważył około 1350 kg i oba były trzymane w osobnych szafkach o wymiarach około 1,5 × 0,9 × 1,8 m . System kosztował 500 000 USD (5,05 mln USD w 2023 r.) Lub można go było wydzierżawić za 3500 USD miesięcznie (40 000 USD od 2023 r.). Jego pamięć bębna pierwotnie zawierała 2000 dziesięciocyfrowych słów, później rozszerzono ją do 4000 słów. Ograniczenia pamięci, takie jak to, miały zdominować programowanie przez dziesięciolecia. Instrukcje programu były pobierane z obracającego się bębna podczas wykonywania kodu. Sprawne wykonanie przy użyciu pamięci bębna zapewniło połączenie architektury sprzętowej – format instrukcji zawierał adres następnej instrukcji – oraz oprogramowania: Symbolic Optimal Assembly Program , SOAP, przydzielono instrukcje pod optymalne adresy (w miarę możliwości analizy statycznej programu źródłowego). W ten sposób wiele instrukcji było w razie potrzeby umieszczanych w następnym rzędzie bębna do odczytania, a dodatkowy czas oczekiwania na obrót bębna został skrócony.

Mikroprogramowanie

W 1951 roku brytyjski naukowiec Maurice Wilkes opracował koncepcję mikroprogramowania , gdy uświadomił sobie, że jednostka centralna komputera może być kontrolowana przez miniaturowy, wysoce wyspecjalizowany program komputerowy w szybkiej pamięci ROM . Mikroprogramowanie umożliwia zdefiniowanie lub rozszerzenie podstawowego zestawu instrukcji za pomocą wbudowanych programów (obecnie nazywanych oprogramowaniem układowym lub mikrokodem ). Ta koncepcja znacznie uprościła rozwój procesora. Po raz pierwszy opisał to na Uniwersytecie w Manchesterze Konferencja inauguracyjna komputera w 1951 r., a następnie opublikowana w rozszerzonej formie w IEEE Spectrum w 1955 r. [ potrzebne źródło ]

Był szeroko stosowany w procesorach i jednostkach zmiennoprzecinkowych komputerów mainframe i innych komputerów; został zaimplementowany po raz pierwszy w EDSAC 2 , który również wykorzystywał wiele identycznych „wycinków bitów”, aby uprościć projekt. Dla każdego bitu procesora zastosowano wymienne, wymienne zespoły rur.

Pamięć magnetyczna

Magnetyczne pamięci bębnowe zostały opracowane dla marynarki wojennej Stanów Zjednoczonych podczas II wojny światowej, a prace były kontynuowane w Engineering Research Associates (ERA) w 1946 i 1947 r. ERA, wówczas część Univac, włączyła pamięć bębnową do swojego 1103 , ogłoszonego w lutym 1953 r. Pierwszy masowo produkowany komputer IBM 650 , również ogłoszony w 1953 r., miał około 8,5 kilobajta pamięci bębna.

z rdzeniem magnetycznym opatentowana w 1949 r., A jej pierwsze użycie zademonstrowano w komputerze Whirlwind w sierpniu 1953 r. Komercjalizacja nastąpiła szybko. Rdzeń magnetyczny zastosowano w urządzeniach peryferyjnych IBM 702 dostarczonego w lipcu 1955 roku, a później w samym 702. IBM 704 (1955) i Ferranti Mercury (1957) wykorzystywały pamięć z rdzeniem magnetycznym. Zdominowała tę dziedzinę do lat 70. XX wieku, kiedy została zastąpiona pamięcią półprzewodnikową. Rdzeń magnetyczny osiągnął szczyt pod względem wielkości około 1975 r., A następnie spadł w użyciu i udziale w rynku.

Jeszcze w 1980 roku maszyny PDP-11/45 wykorzystujące pamięć główną z rdzeniem magnetycznym i bębny do wymiany były nadal używane w wielu oryginalnych witrynach UNIX.

Charakterystyka wczesnych komputerów cyfrowych

| Nazwa | Pierwszy operacyjny | System liczbowy | Mechanizm obliczeniowy | Programowanie | Kompletny Turinga |

|---|---|---|---|---|---|

| Arthur H. Dickinson IBM (Stany Zjednoczone) | styczeń 1940 r | Dziesiętny | Elektroniczny | Nie programowalny | NIE |

| Joseph Desch RNK (Stany Zjednoczone) | marzec 1940 r | Dziesiętny | Elektroniczny | Nie programowalny | NIE |

| Zuse Z3 (Niemcy) | maj 1941 r | Binarny zmiennoprzecinkowy | Elektromechaniczny | Sterowane programem przez perforowaną taśmę filmową 35 mm (ale bez gałęzi warunkowej) | Teoretycznie ( 1998 ) |

| Komputer Atanasoff-Berry (USA) | 1942 | Dwójkowy | Elektroniczny | Nie programowalny — jeden cel | NIE |

| Colossus Mark 1 (Wielka Brytania) | luty 1944 | Dwójkowy | Elektroniczny | Sterowane programowo za pomocą kabli połączeniowych i przełączników | NIE |

| Harvard Mark I – IBM ASCC (USA) | maj 1944 r | Dziesiętny | Elektromechaniczny | Sterowany programem przez 24-kanałową taśmę perforowaną (ale bez rozgałęzień warunkowych) | Sporny |

| Colossus Mark 2 (Wielka Brytania) | czerwiec 1944 | Dwójkowy | Elektroniczny | Sterowane programowo za pomocą kabli połączeniowych i przełączników | Przypuszczalny (2011) |

| Zuse Z4 (Niemcy) | marzec 1945 r | Binarny zmiennoprzecinkowy | Elektromechaniczny | Program sterowany przez perforowaną taśmę filmową 35 mm | w 1950 roku |

| ENIAC (Stany Zjednoczone) | luty 1946 | Dziesiętny | Elektroniczny | Sterowane programowo za pomocą kabli połączeniowych i przełączników | Tak |

| ARC2 (SEC) (Wielka Brytania) | maj 1948 | Dwójkowy | Elektroniczny | Zapisany program w pamięci obracającego się bębna | Tak |

| Manchester Baby (Wielka Brytania) | czerwiec 1948 | Dwójkowy | Elektroniczny | Zapisany program w pamięci lampy katodowej Williamsa | Tak |

| Zmodyfikowany ENIAC (USA) | wrzesień 1948 r | Dziesiętny | Elektroniczny | Zapisany mechanizm programowania tylko do odczytu wykorzystujący tablice funkcji jako pamięć ROM programu | Tak |

| Manchester Mark 1 (Wielka Brytania) | kwiecień 1949 r | Dwójkowy | Elektroniczny | Zapisany program w pamięci lampy elektronopromieniowej Williamsa i pamięci bębna magnetycznego | Tak |

| EDSAC (Wielka Brytania) | maj 1949 | Dwójkowy | Elektroniczny | Zapisany program w pamięci linii opóźniającej rtęci | Tak |

| CSIRAC (Australia) | listopad 1949 | Dwójkowy | Elektroniczny | Zapisany program w pamięci linii opóźniającej rtęci | Tak |

Komputery tranzystorowe

Tranzystor bipolarny został wynaleziony w 1947 roku. Od 1955 roku tranzystory zastąpiły lampy próżniowe w konstrukcjach komputerowych, dając początek „drugiej generacji” komputerów. W porównaniu z lampami próżniowymi tranzystory mają wiele zalet: są mniejsze i wymagają mniej energii niż lampy próżniowe, więc wydzielają mniej ciepła. Tranzystory krzemowe były znacznie bardziej niezawodne niż lampy próżniowe i miały dłuższą żywotność. Komputery tranzystorowe mogą zawierać dziesiątki tysięcy binarnych obwodów logicznych na stosunkowo niewielkiej przestrzeni. Tranzystory znacznie zmniejszyły rozmiar komputerów, koszty początkowe i koszty operacyjne . Zazwyczaj komputery drugiej generacji składały się z dużej liczby płytek drukowanych, takich jak IBM Standard Modular System , z których każda zawierała od jednej do czterech bramek logicznych lub przerzutników .

Na Uniwersytecie w Manchesterze zespół pod kierownictwem Toma Kilburna zaprojektował i zbudował maszynę wykorzystującą nowo opracowane tranzystory zamiast zaworów. Początkowo jedynymi dostępnymi urządzeniami były germanowe tranzystory punktowe , mniej niezawodne niż zastąpione przez nie zawory, ale zużywające znacznie mniej energii. Ich pierwszy komputer tranzystorowy i pierwszy na świecie działał do 1953 r. , a drugą wersję ukończono tam w kwietniu 1955 r. Wersja z 1955 r. wykorzystywała 200 tranzystorów, 1300 diody półprzewodnikowe i miał pobór mocy 150 watów. Jednak maszyna wykorzystywała zawory do generowania przebiegów zegara 125 kHz oraz w obwodach do odczytu i zapisu w pamięci bębna magnetycznego, więc nie był to pierwszy całkowicie tranzystorowy komputer.

Wyróżnienie to należy się Harwell CADET z 1955 roku, zbudowanemu przez oddział elektroniczny Atomic Energy Research Establishment w Harwell . Projekt obejmował 64-kilobajtowy magazyn pamięci bębna magnetycznego z wieloma ruchomymi głowicami, który został zaprojektowany w National Physical Laboratory w Wielkiej Brytanii . W 1953 roku zespół ten dysponował obwodami tranzystorowymi do odczytu i zapisu na mniejszym bębnie magnetycznym z Royal Radar Establishment . Maszyna wykorzystywała niską częstotliwość zegara wynoszącą zaledwie 58 kHz, aby uniknąć konieczności używania jakichkolwiek zaworów do generowania przebiegów zegara.

CADET wykorzystał 324-punktowe tranzystory dostarczone przez brytyjską firmę Standard Telephones and Cables ; We wzmacniaczach pierwszego stopnia do odczytu danych z bębna zastosowano 76 tranzystorów złączowych , ponieważ tranzystory punktowe były zbyt głośne. Od sierpnia 1956 roku firma CADET oferowała regularną usługę obliczeniową, podczas której często wykonywała nieprzerwane cykle obliczeniowe trwające 80 godzin i więcej. średni czas między awariami maszyny wynosił około 90 minut, ale poprawiło się to, gdy bardziej niezawodne tranzystory bipolarne .

Projekt komputera tranzystorowego Manchester University został przyjęty przez lokalną firmę inżynieryjną Metropolitan-Vickers w ich Metrovick 950 , pierwszym komercyjnym komputerze tranzystorowym na świecie. Zbudowano sześć Metrovick 950, pierwszy ukończono w 1956 roku. Zostały one z powodzeniem wdrożone w różnych działach firmy i były używane przez około pięć lat. Komputer drugiej generacji, IBM 1401 , zdobył około jednej trzeciej światowego rynku. IBM zainstalował ponad dziesięć tysięcy 1401 w latach 1960-1964.

Tranzystorowe urządzenia peryferyjne

Tranzystorowa elektronika usprawniła nie tylko CPU (Central Processing Unit), ale także urządzenia peryferyjne . Jednostki dyskowe do przechowywania danych drugiej generacji były w stanie przechowywać dziesiątki milionów liter i cyfr. Obok na dyskach stałych , połączonych z procesorem za pomocą szybkiej transmisji danych, znajdowały się jednostki pamięci na dyskach wymiennych. Wymienny pakiet dysków można łatwo wymienić na inny pakiet w ciągu kilku sekund. Nawet jeśli pojemność dysków wymiennych jest mniejsza niż dysków stałych, ich wymienność gwarantuje niemal nieograniczoną ilość danych w zasięgu ręki. Taśma magnetyczna zapewniała możliwość archiwizacji tych danych po niższych kosztach niż dysk.

Wiele procesorów drugiej generacji delegowało komunikację z urządzeniami peryferyjnymi do procesora pomocniczego. Na przykład, podczas gdy procesor komunikacyjny sterował odczytem i dziurkowaniem kart , główny procesor wykonywał obliczenia i binarne instrukcje rozgałęzienia . Jedna magistrala danych przenosiłaby dane między głównym procesorem a pamięcią rdzeniową z szybkością cyklu pobierania-wykonania procesora , a inne magistrale danych zazwyczaj obsługiwałyby urządzenia peryferyjne. Na PDP-1 , czas cyklu pamięci rdzenia wynosił 5 mikrosekund; w konsekwencji większość instrukcji arytmetycznych zajmowała 10 mikrosekund (100 000 operacji na sekundę), ponieważ większość operacji zajmowała co najmniej dwa cykle pamięci; jeden dla instrukcji, jeden dla operandu .

Podczas drugiej generacji zdalnych terminali (często w postaci dalekopisów , takich jak Friden Flexowriter ) znacznie wzrosło użycie. Połączenia telefoniczne zapewniały wystarczającą prędkość dla wczesnych zdalnych terminali i pozwalały na setki kilometrów separacji między zdalnymi terminalami a centrum obliczeniowym. Ostatecznie te autonomiczne sieci komputerowe zostałyby uogólnione w połączoną sieć sieci — Internet.

Superkomputery tranzystorowe

Wczesne lata sześćdziesiąte przyniosły nadejście superkomputerów . Atlas był wspólnym dziełem Uniwersytetu w Manchesterze , Ferranti i Plessey , po raz pierwszy zainstalowany na Uniwersytecie w Manchesterze i oficjalnie oddany do użytku w 1962 roku jako jeden z pierwszych superkomputerów na świecie – uważany wówczas za najpotężniejszy komputer na świecie . Mówiono, że za każdym razem, gdy Atlas przechodził w tryb offline, utracono połowę mocy obliczeniowej komputerów w Wielkiej Brytanii. Była to maszyna drugiej generacji, wykorzystująca dyskretny german tranzystory . Atlas był także pionierem Atlas Supervisor , „uważanego przez wielu za pierwszy rozpoznawalny nowoczesny system operacyjny ”.

W Stanach Zjednoczonych seria komputerów w Control Data Corporation (CDC) została zaprojektowana przez Seymoura Craya w celu wykorzystania innowacyjnych projektów i równoległości w celu osiągnięcia najwyższej szczytowej wydajności obliczeniowej. CDC 6600 , wydany w 1964 roku, jest powszechnie uważany za pierwszy superkomputer. CDC 6600 przewyższył swojego poprzednika, IBM 7030 Stretch , o około 3 razy. Z wydajnością około 1 megaFLOPS , CDC 6600 był najszybszym komputerem na świecie od 1964 do 1969 roku, kiedy to zrezygnował z tego statusu na rzecz swojego następcy, CDC 7600 .

Komputery z układami scalonymi

„Trzecia generacja” cyfrowych komputerów elektronicznych wykorzystywała układy scalone (IC) jako podstawę swojej logiki.

Pomysł układu scalonego został opracowany przez naukowca zajmującego się radarami, pracującego dla Royal Radar Establishment Ministerstwa Obrony , Geoffreya WA Dummera .

Pierwsze działające układy scalone zostały wynalezione przez Jacka Kilby'ego z Texas Instruments i Roberta Noyce'a z Fairchild Semiconductor . Kilby nagrał swoje wstępne pomysły dotyczące układu scalonego w lipcu 1958 r., Z powodzeniem demonstrując pierwszy działający zintegrowany przykład 12 września 1958 r. Wynalazek Kilby'ego był hybrydowym układem scalonym (hybrydowy układ scalony). Miał zewnętrzne połączenia przewodowe, co utrudniało masową produkcję.

Noyce wpadł na własny pomysł układu scalonego pół roku po Kilby. Wynalazkiem Noyce'a był monolityczny układ scalony (IC). Jego chip rozwiązał wiele praktycznych problemów, których nie miał Kilby. Wyprodukowany w Fairchild Semiconductor, został wykonany z krzemu , natomiast chip Kilby'ego z germanu . Podstawą monolitycznego układu scalonego Noyce'a był planarny proces Fairchilda , który umożliwił układanie układów scalonych przy użyciu tych samych zasad, co w przypadku obwodów drukowanych . Proces planarny został opracowany przez kolegę Noyce'a, Jeana Hoerniego , na początku 1959 roku, w oparciu o prace Mohameda M. Atalla nad pasywacją powierzchni półprzewodników za pomocą dwutlenku krzemu w Bell Labs pod koniec lat pięćdziesiątych.

Komputery trzeciej generacji (z układami scalonymi) pojawiły się po raz pierwszy na początku lat 60. XX wieku w komputerach opracowanych dla celów rządowych, a następnie od połowy lat 60. w komputerach komercyjnych. Pierwszym krzemowym komputerem IC był Apollo Guidance Computer lub AGC. Chociaż nie był to najpotężniejszy komputer swoich czasów, ekstremalne ograniczenia rozmiaru, masy i mocy statku kosmicznego Apollo wymagały, aby AGC był znacznie mniejszy i gęstszy niż jakikolwiek wcześniejszy komputer, ważący zaledwie 70 funtów (32 kg). Każda misja lądowania na Księżycu zawierała dwa AGC, po jednym w module dowodzenia i wznoszenia na Księżyc.

Pamięć półprzewodnikowa

MOSFET (tranzystor polowy z efektem metal-tlenek-półprzewodnik lub tranzystor MOS) został wynaleziony przez Mohameda M. Atallę i Dawona Kahnga w Bell Labs w 1959 r. Oprócz przetwarzania danych, MOSFET umożliwił praktyczne wykorzystanie tranzystorów MOS jako pamięci elementy do przechowywania komórek , funkcję pełnioną wcześniej przez rdzenie magnetyczne . Pamięć półprzewodnikowa , znana również jako pamięć MOS , była tańsza i zużywała mniej energii niż pamięć z rdzeniem magnetycznym . Pamięć o swobodnym dostępie MOS (RAM), w postaci statycznej pamięci RAM (SRAM), został opracowany przez Johna Schmidta w Fairchild Semiconductor w 1964 r. W 1966 r. Robert Dennard z IBM Thomas J. Watson Research Center opracował dynamiczną pamięć RAM MOS (DRAM). W 1967 roku Dawon Kahng i Simon Sze z Bell Labs opracowali MOSFET z pływającą bramką , będący podstawą pamięci nieulotnej MOS, takiej jak EPROM , EEPROM i pamięć flash .

Komputery mikroprocesorowe

„Czwarta generacja” cyfrowych komputerów elektronicznych wykorzystywała mikroprocesory jako podstawę swojej logiki. Mikroprocesor wywodzi się z układu scalonego MOS (MOS IC). Ze względu na szybkie skalowanie MOSFET , złożoność chipów MOS IC gwałtownie wzrosła w tempie przewidzianym przez prawo Moore'a , co doprowadziło do integracji na dużą skalę (LSI) z setkami tranzystorów w jednym chipie MOS pod koniec lat 60. Zastosowanie chipów MOS LSI w informatyce był podstawą pierwszych mikroprocesorów, ponieważ inżynierowie zaczęli dostrzegać, że kompletny procesor komputerowy może być zawarty w pojedynczym chipie MOS LSI.

Kwestia, które dokładnie urządzenie było pierwszym mikroprocesorem, jest kontrowersyjna, częściowo z powodu braku porozumienia co do dokładnej definicji terminu „mikroprocesor”. Najwcześniejszymi mikroprocesorami wieloukładowymi były Four-Phase Systems AL-1 z 1969 r. I Garrett AiResearch MP944 z 1970 r., Opracowane z wieloma chipami MOS LSI. Pierwszym jednoukładowym mikroprocesorem był Intel 4004 , opracowany na pojedynczym układzie PMOS LSI. Został zaprojektowany i zrealizowany przez Ted Hoff , Federico Faggin , Masatoshi Shima i Stanley Mazor z firmy Intel , wydany w 1971 roku. Tadashi Sasaki i Masatoshi Shima z firmy Busicom , producenta kalkulatorów, początkowo doszli do wniosku, że procesor może być pojedynczym układem MOS LSI, dostarczonym przez firmę Intel.

Podczas gdy najwcześniejsze układy scalone mikroprocesorów zawierały dosłownie tylko procesor, tj. jednostkę centralną komputera, ich stopniowy rozwój w naturalny sposób doprowadził do powstania chipów zawierających większość lub wszystkie wewnętrzne części elektroniczne komputera. Układ scalony na obrazku po prawej stronie, na przykład Intel 8742, to 8-bitowy mikrokontroler , który zawiera procesor działający z częstotliwością 12 MHz, 128 bajtów pamięci RAM , 2048 bajtów pamięci EPROM oraz wejścia/wyjścia w tym samym układzie .

W latach sześćdziesiątych technologie drugiej i trzeciej generacji w znacznym stopniu się pokrywały. IBM wdrożył swoje moduły IBM Solid Logic Technology w obwodach hybrydowych dla IBM System / 360 w 1964 r. Jeszcze w 1975 r. Sperry Univac kontynuował produkcję maszyn drugiej generacji, takich jak UNIVAC 494. Duże systemy Burroughs , takie jak B5000, były maszyny stosowe , co pozwoliło na prostsze programowanie. Te automaty przesuwające zostały później zaimplementowane również w minikomputerach i mikroprocesorach, co wpłynęło na projektowanie języków programowania. Minikomputery służyły jako tanie centra komputerowe dla przemysłu, biznesu i uczelni. Możliwe stało się symulowanie obwodów analogowych za pomocą programu symulacyjnego z naciskiem na układy scalone lub SPICE (1971) na minikomputerach, jednego z programów do automatyzacji projektowania elektronicznego ( EDA ). Mikroprocesor doprowadził do rozwoju mikrokomputerów , małe, niedrogie komputery, które mogłyby być własnością osób fizycznych i małych firm. Mikrokomputery, z których pierwszy pojawił się w latach 70., stały się wszechobecne w latach 80. i później.

Chociaż to, który konkretny produkt jest uważany za pierwszy system mikrokomputerowy, jest przedmiotem dyskusji, jednym z najwcześniejszych jest Micral N firmy R2E ( François Gernelle , André Truong ), wprowadzony na rynek „na początku 1973 r.” Przy użyciu procesora Intel 8008. Pierwszym dostępnym na rynku zestawem mikrokomputerowym był Intel Altair 8800 oparty na procesorze 8080 , który został ogłoszony w artykule na okładce Popular Electronics ze stycznia 1975 roku . Jednak Altair 8800 był bardzo ograniczonym systemem na początkowych etapach, mając tylko 256 bajtów pamięci DRAM w swoim początkowym opakowaniu i bez wejścia-wyjścia, z wyjątkiem przełączników dwustabilnych i wyświetlacza rejestru LED. Mimo to początkowo był zaskakująco popularny, z kilkuset sprzedażami w pierwszym roku, a popyt szybko przewyższył podaż. Kilku wczesnych dostawców zewnętrznych, takich jak Cromemco i Processor Technology , wkrótce zaczęło dostarczać dodatkowy sprzęt magistrali S-100 dla Altair 8800.

W kwietniu 1975 roku na targach w Hanowerze Olivetti zaprezentował P6060 , pierwszy na świecie kompletny, wstępnie zmontowany system komputera osobistego . Jednostka centralna składała się z dwóch kart o nazwach kodowych PUCE1 i PUCE2 iw przeciwieństwie do większości innych komputerów osobistych została zbudowana z komponentów TTL , a nie z mikroprocesora. Miał jedną lub dwie 8- calowe stacje dyskietek , 32-znakowy wyświetlacz plazmowy , 80-kolumnową graficzną drukarkę termiczną , 48 KB pamięci RAM i BASIC język. Ważył 40 kg (88 funtów). Jako kompletny system był to znaczący krok w stosunku do Altaira, chociaż nigdy nie osiągnął takiego samego sukcesu. Konkurował z podobnym produktem IBM, który miał zewnętrzną stację dyskietek.

Od 1975 do 1977 roku większość mikrokomputerów, takich jak technologia MOS KIM-1 , Altair 8800 i niektóre wersje Apple I , była sprzedawana jako zestawy dla majsterkowiczów. Wstępnie zmontowane systemy zyskały na popularności dopiero w 1977 roku, kiedy to pojawiły się Apple II , Tandy TRS-80 , pierwsze komputery SWTPC i Commodore PET . Komputery ewoluowały wraz z architekturą mikrokomputerów, dodając funkcje ich większych braci, dominujących obecnie w większości segmentów rynku.

Komputer NeXT oraz jego zorientowane obiektowo narzędzia programistyczne i biblioteki zostały wykorzystane przez Tima Bernersa-Lee i Roberta Cailliau z CERN do opracowania pierwszego na świecie oprogramowania serwera sieciowego , CERN httpd , a także do napisania pierwszej przeglądarki internetowej , WorldWideWeb .

Systemy tak skomplikowane jak komputery wymagają bardzo dużej niezawodności . ENIAC działał nieprzerwanie od 1947 do 1955 roku przez osiem lat, zanim został zamknięty. Chociaż rura próżniowa może ulec awarii, zostanie wymieniona bez wyłączania systemu. Dzięki prostej strategii nigdy nie wyłączania ENIAC awarie zostały radykalnie zmniejszone. Lampowe komputery przeciwlotnicze SAGE stały się niezwykle niezawodne – zainstalowane parami, jedna poza linią, lampy, które prawdopodobnie uległy awarii, działały, gdy komputer był celowo uruchamiany ze zmniejszoną mocą, aby je znaleźć . Możliwość podłączania podczas pracy dyski twarde, podobnie jak lampy próżniowe podłączane podczas pracy z przeszłości, kontynuują tradycję naprawy podczas ciągłej pracy. Pamięci półprzewodnikowe zwykle nie mają błędów podczas działania, chociaż systemy operacyjne, takie jak Unix, stosowały testy pamięci podczas uruchamiania w celu wykrycia awarii sprzętu. Obecnie wymóg niezawodnej wydajności staje się jeszcze bardziej rygorystyczny, gdy platformą dostarczania są farmy serwerów . Google poradził sobie z tym, używając oprogramowania odpornego na awarie do odzyskiwania po awariach sprzętu, a nawet pracuje nad koncepcją wymiany całych farm serwerów w locie, podczas zdarzenia serwisowego.

W XXI wieku wielordzeniowe procesory stały się dostępne na rynku. Pamięć adresowana do zawartości (CAM) stała się wystarczająco niedroga, aby można jej było używać w sieciach, i jest często używana jako pamięć podręczna na chipie w nowoczesnych mikroprocesorach, chociaż żaden system komputerowy nie zaimplementował jeszcze sprzętowych CAM do użytku w językach programowania. Obecnie CAM (lub tablice asocjacyjne) w oprogramowaniu są specyficzne dla języka programowania. Macierze półprzewodnikowych komórek pamięci są bardzo regularnymi strukturami, a producenci udowadniają na nich swoje procesy; pozwala to na obniżki cen produktów pamięciowych. W latach 80-tych CMOS bramki logiczne rozwinęły się w urządzenia, które można było wykonać tak szybko, jak inne typy obwodów; zużycie energii przez komputer można zatem radykalnie zmniejszyć. W przeciwieństwie do ciągłego poboru prądu przez bramkę opartą na innych typach logicznych, bramka CMOS pobiera znaczny prąd tylko podczas „przejścia” między stanami logicznymi, z wyjątkiem wycieku.

Obwody CMOS pozwoliły komputerom stać się towarem , który jest obecnie wszechobecny, osadzony w wielu formach , od kart okolicznościowych i telefonów po satelity . Projektowa moc cieplna , która jest rozpraszana podczas pracy, stała się równie istotna jak prędkość obliczeniowa działania. W 2006 roku serwery pochłaniały 1,5% całkowitego budżetu energetycznego Stanów Zjednoczonych Oczekiwano, że do 2011 roku zużycie energii w komputerowych centrach danych podwoi się do 3% światowego zużycia. SoC (system on a chip) skompresował jeszcze więcej układów scalonych w jeden układ; SoC umożliwiają połączenie telefonów i komputerów PC w pojedyncze przenośne, bezprzewodowe urządzenia przenośne .

Obliczenia kwantowe to nowa technologia w dziedzinie informatyki. MIT Technology Review poinformował 10 listopada 2017 r., Że IBM stworzył 50- kubitowy komputer; obecnie jego stan kwantowy trwa 50 mikrosekund. Badacze Google byli w stanie wydłużyć limit czasu 50 mikrosekund, jak podano 14 lipca 2021 r. w Nature ; stabilność została zwiększona 100-krotnie poprzez rozłożenie pojedynczego kubitu logicznego na łańcuchy kubitów danych w celu kwantowej korekcji błędów . Przegląd fizyczny X zgłosił technikę „wykrywania pojedynczej bramki jako realnej metody odczytu kubitów spinowych” (stan spinu singletowo-trypletowego w krzemie) w dniu 26 listopada 2018 r. Zespołowi Google udało się uruchomić układ modulatora impulsów RF przy 3 kelwinach, upraszczając kriogenika ich 72-kubitowego komputera, który jest skonfigurowany do pracy w temperaturze 0,3 kelwina; ale obwody odczytu i inny sterownik pozostają do wprowadzenia do kriogeniki. Zobacz: Supremacja kwantowa Systemy kubitów krzemowych wykazały splątanie na odległościach nielokalnych .

Sprzęt komputerowy i jego oprogramowanie stały się nawet metaforą działania wszechświata.

Epilog

O szybkości rozwoju tej dziedziny można wywnioskować z historii przełomowego artykułu Burksa, Goldstine'a i von Neumanna z 1947 roku. Zanim ktokolwiek zdążył coś zapisać, było to przestarzałe. Pierwszy szkic raportu Johna von Neumanna o EDVAC i natychmiast przystąpili do wdrażania własnych systemów. Do dziś szybkie tempo rozwoju utrzymuje się na całym świecie.

Zobacz też

- Mechanizm z Antykithiry

- Historia informatyki

- Historia sprzętu komputerowego (1960-obecnie)

- Historia laptopów

- Historia komputerów osobistych

- Historia oprogramowania

- Wiek informacji

- Towarzystwo Historii Informatyki

- Retrokomputery

- Oś czasu obliczeń

- Lista pionierów informatyki

- Komputer próżniowy

Notatki

- Backus, John (sierpień 1978), „Can Programming Be Liberated from the von Neumann Style?”, Communications of the ACM , 21 (8): 613, doi : 10.1145/359576.359579 , S2CID 16367522 , 1977 ACM Turing Award Lecture

- Bell, Gordon ; Newell, Allen (1971), Struktury komputerowe: odczyty i przykłady , Nowy Jork: McGraw-Hill, ISBN 0-07-004357-4

- Bergin, Thomas J., wyd. (13–14 listopada 1996), Fifty Years of Army Computing: from ENIAC to MSRC (PDF) , Zapis sympozjum i uroczystości, Aberdeen Proving Ground .: Army Research Laboratory and the USArmy Ordnance Center and School., zarchiwizowane z oryginał (PDF) w dniu 2008-05-29 , pobrano 2008-05-17

- Bowden, BV (1970), „The Language of Computers” , American Scientist , 58 (1): 43–53, Bibcode : 1970AmSci..58...43B , zarchiwizowane z oryginału w dniu 20.10.2006 , pobrane 2008 -05-17

- Budiansky, Stephen (2000), Battle of rozum: The Complete Story of Codebreaking in World War II , Free Press, ISBN 978-0684859323

- Burks Arthur W .; Goldstine, Herman ; von Neumann, John (1947), Wstępna dyskusja na temat projektu logicznego elektronicznego instrumentu komputerowego , Princeton, NJ: Institute for Advanced Study, zarchiwizowane z oryginału w dniu 15.05.2008 , pobrane 18.05.2008

- Chua, Leon O (wrzesień 1971), „Memristor - brakujący element obwodu”, IEEE Transactions on Circuit Theory , CT-18 (5): 507–519, CiteSeerX 10.1.1.404.9037 , doi : 10.1109/TCT.1971.1083337

- Cleary, JF (1964), GE Transistor Manual (wyd. 7), General Electric, Semiconductor Products Department, Syracuse, NY, s. 139–204, OCLC 223686427

- Copeland, B. Jack, wyd. (2006), Colossus: The Secrets of Bletchley Park's Codebreaking Computers , Oxford, Anglia: Oxford University Press , ISBN 0-19-284055-X

- Coriolis, Gaspard-Gustave (1836), „Note sur un moyen de tracer des courbes données par des équations différentielles” , Journal de Mathématiques Pures et Appliquées , seria I (w języku francuskim), 1 : 5–9, zarchiwizowane od oryginału w dniu 2019-07-03 , pobrane 2008-07-06

- Cortada, James W. (2009), „Polityka publiczna i rozwój krajowych branż komputerowych w Wielkiej Brytanii, Francji i Związku Radzieckim, 1940–80”, Journal of Contemporary History , 44 (3): 493–512, doi : 10.1177/0022009409104120 , JSTOR 40543045 , S2CID 159510351

- CSIRAC: pierwszy komputer w Australii , Commonwealth Scientific and Industrial Research Organization (CSIRAC), 3 czerwca 2005, zarchiwizowane z oryginału w dniu 13.12.2011 , pobrane 21.12.2007

- Da Cruz, Frank (28 lutego 2008), „The IBM Automatic Sequence Controlled Calculator (ASCC)” , Columbia University Computing History: A Chronology of Computing at Columbia University , Columbia University ACIS, zarchiwizowane od oryginału w dniu 2008-05-12 , pobrane 2008-05-17

- Davenport, Wilbur B. Jr; Root, William L. (1958), „Wprowadzenie do teorii sygnałów losowych i szumów”, Physics Today , 11 (6): 112–364, Bibcode : 1958PhT....11f..30D , doi : 10.1063/ 1.3062606

- Eckert, Wallace (1935), "The Computation of Special Perturbations by the Punched Card Method.", Astronomical Journal , 44 (1034): 177, Bibcode : 1935AJ.....44..177E , doi : 10.1086/105298

- Eckert, Wallace (1940), „XII: „Obliczenia perturbacji planetarnych” ”, Metody kart perforowanych w obliczeniach naukowych , Thomas J. Watson Astronomical Computing Bureau, Columbia University, s. 101–114, hdl : 2027/uc1.b3621946 , OCLC 2275308

- Eckhouse, Richard H. Jr.; Morris, L. Robert (1979), Systemy minikomputerowe: organizacja, programowanie i aplikacje (PDP-11) , Prentice-Hall, s. 1–2, ISBN 0-13-583914-9

- Enticknap, Nicholas (lato 1998), „Computing's Golden Jubilee” , Resurrection , The Computer Conservation Society (20), ISSN 0958-7403 , zarchiwizowane z oryginału w dniu 09.01.2012 , pobrane 19.04.2008

- Evans, Claire L. (2018). Broad Band: nieopowiedziana historia kobiet, które stworzyły Internet . Nowy Jork: Portfolio/Pingwin. ISBN 9780735211759 . Zarchiwizowane od oryginału w dniu 2023-02-02 . Źródło 2020-10-18 .

- Feynman, RP ; Leighton, Robert ; Sands, Matthew (1965), Feynman Wykłady z fizyki: głównie mechanika, promieniowanie i ciepło , tom. I, Czytanie, Msza: Addison-Wesley, ISBN 0-201-02010-6 , OCLC 531535

- Feynman, RP ; Leighton, Robert ; Sands, Matthew (1966), Wykłady Feynmana z fizyki: mechanika kwantowa , tom. III, Czytanie, Msza: Addison-Wesley, ASIN B007BNG4E0

- Fisk, Dale (2005), karty dziurkacza (PDF) , Columbia University ACIS, zarchiwizowane (PDF) z oryginału w dniu 14.05.2008 , pobrane 19.05.2008

- Flamm, Kenneth (1987), Targeting the Computer: Government Support and International Competition , Washington, DC: Brookings Institution Press , ISBN 978-0-815-72852-8

- Flamm, Kenneth (1988), Tworzenie komputera: rząd, przemysł i zaawansowana technologia , Waszyngton: Brookings Institution Press , ISBN 978-0-815-72850-4

- Hollerith, Herman (1890). W związku z elektrycznym systemem tabulacji, który został przyjęty przez rząd USA do pracy biura spisowego (rozprawa doktorska). Szkoła Górnicza Uniwersytetu Columbia .

- Horowitz, Paweł; Hill, Winfield (1989), The Art of Electronics (wyd. 2), Cambridge University Press, ISBN 0-521-37095-7

- Hunt, J. cr (1998), „Lewis Fry Richardson i jego wkład w matematykę, meteorologię i modele konfliktów” (PDF) , Annu. Wielebny mechanik płynów. , 30 (1): XIII–XXXVI, Bibcode : 1998AnRFM..30D..13H , doi : 10.1146/annurev.fluid.30.1.0 , zarchiwizowane z oryginału (PDF) w dniu 2008-02-27 , pobrane 2008-06 -15

- IBM (wrzesień 1956), jednostka pamięci dyskowej IBM 350 , IBM, zarchiwizowane z oryginału w dniu 2008-05-31 , pobrane 2008-07-01

- IBM (1960), IBM Standard Modular System SMS Cards , IBM, zarchiwizowane z oryginału w dniu 2007-12-06 , pobrane 2008-03-06

- Intel (listopad 1971), pierwszy mikroprocesor Intela - Intel 4004 , Intel Corp., zarchiwizowane z oryginału w dniu 13.05.2008 , pobrane 17.05.2008

- Jones, Douglas W, Punched Cards: Krótka ilustrowana historia techniczna , The University of Iowa , zarchiwizowane z oryginału w dniu 2008-05-09 , pobrane 2008-05-15

- Kalman, RE (1960), „Nowe podejście do problemów z filtrowaniem liniowym i przewidywaniem” (PDF) , Journal of Basic Engineering , 82 (1): 35–45, doi : 10.1115/1.3662552 , zarchiwizowane z oryginału (PDF) w dniu 2008-05-29 , pobrane 2008-05-03

- Kells; Kern; Bland (1943), The Log-Log Duplex Decitrig Slide Suwak nr 4081: A Manual , Keuffel & Esser, s. 92, zarchiwizowane z oryginału w dniu 01.05.2015 , pobrane 31.05.2014

- Kilby, Jack (2000), wykład Nobla (PDF) , Sztokholm: Fundacja Nobla, zarchiwizowane (PDF) z oryginału w dniu 2008-05-29 , pobrane 2008-05-15

- Kohonen, Teuvo (1980), Pamięci adresowalne treścią , Springer-Verlag, s. 368, ISBN 0-387-09823-2

- Lavington, Simon (1998), A History of Manchester Computers (wyd. 2), Swindon: The British Computer Society

- Lazos, Christos (1994), Ο ΥΠΟΛΟΓΙΣΤΗΣ ΤΩΝ ΑΝΤΙΚΥΘΗΡΩΝ [ Komputer z Antykithiry ], ΑΙΟΛΟΣ PUBLIKACJE GR

- Leibniz, Gottfried (1703), Explication de l'Arithmétique Binaire